Immaginate un ingegnere sul campo nel seminterrato di cemento di un impianto di produzione, completamente isolato dalle reti cellulari e wireless. Ha la necessità di estrarre specifiche clausole di sicurezza elettrica da un complesso manuale tecnico di 500 pagine utilizzando un editor PDF mobile, eseguire una routine diagnostica complicata e registrare i dati preliminari di conformità nel sistema CRM aziendale. È dotata di un iPhone 11 fornito dall'azienda. Tre piani sopra di lei, il responsabile del sito monitora i flussi di dati in entrata su un iPhone 14 Pro, in attesa che il sistema si sincronizzi. Questo ambiente rappresenta il vero banco di prova operativo per l'intelligenza artificiale moderna. Non si tratta di ciò che gli algoritmi possono ottenere in condizioni di laboratorio asettiche, ma di ciò che possono eseguire nelle dure realtà offline del commercio quotidiano.

L'IA aziendale abilitata all'edge è la pratica di eseguire reti neurali ottimizzate direttamente sull'hardware locale per garantire un'elaborazione computazionale ininterrotta, indipendentemente dalla connettività di rete esterna. Nei miei sei anni di lavoro come ingegnere specializzato in IA, costruendo architetture che operano sul campo, ho capito che l'utilità dipende interamente da questa resilienza localizzata. I leader tecnologici e i direttori operativi — i principali architetti di questi ecosistemi digitali — si stanno rendendo conto che la potenza di calcolo grezza conta molto meno dell'accessibilità. Quando costruiamo sistemi per l'uso sul campo, non stiamo solo scrivendo codice; stiamo progettando autonomia locale.

La frammentazione hardware: il test finale per l'implementazione

Una delle realtà più persistenti nella tecnologia aziendale è il parco dispositivi eterogeneo. Le organizzazioni raramente aggiornano ogni dispositivo simultaneamente. Un ecosistema aziendale può facilmente contenere dispositivi legacy entry-level, strumenti di fascia media e top di gamma, tutti operanti contemporaneamente. Sviluppare software che presuppone la massima capacità hardware è una via garantita verso il fallimento operativo.

Nello sviluppo di soluzioni mobili basate sull'IA, l'architettura deve scalare in modo elastico su tutto questo spettro hardware. Un dispositivo più vecchio, limitato dal suo motore neurale e dai vincoli termici, deve comunque eseguire compiti fondamentali di machine learning senza esaurire la batteria in venti minuti. Al contrario, quando l'applicazione gira su hardware più recente, come l'iPhone 14 standard o l'iPhone 14 Plus con schermo più grande, dovrebbe attingere intuitivamente a una maggiore larghezza di banda della memoria e ad architetture di memoria unificata più veloci per elaborare inferenze locali più complesse. Il software deve valutare dinamicamente l'hardware su cui risiede e regolare di conseguenza il suo carico computazionale.

Questa scalabilità dinamica è fondamentale perché il flusso di lavoro dell'utente finale rimane identico indipendentemente dal dispositivo. Il tecnico conta sui propri strumenti affinché funzionino in modo affidabile. Se uno strumento di analisi dei contratti richiede l'elaborazione in cloud per riassumere un documento e il tecnico perde la connettività, l'applicazione smette effettivamente di esistere. Spingendo modelli ottimizzati e specifici per il compito direttamente all'edge, garantiamo che le funzioni fondamentali sopravvivano al degrado della rete.

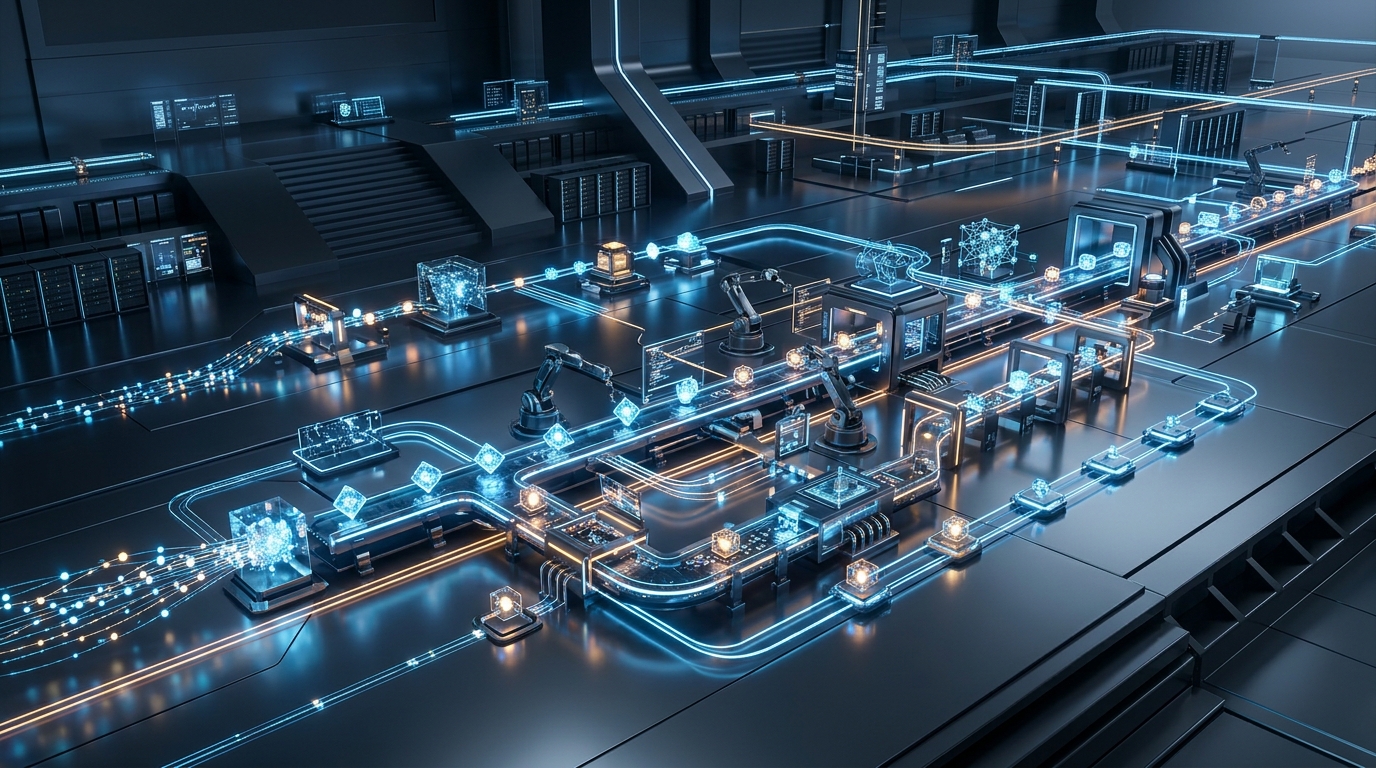

Le organizzazioni stanno costruendo ecosistemi di elaborazione localizzati

L'industria si sta allontanando dal presupposto che tutta l'intelligenza artificiale debba risiedere in server farm centralizzate e distanti. Il sovraccarico logistico e finanziario della trasmissione di ogni singolo dato aziendale avanti e indietro verso un server sta diventando insostenibile, specialmente con il moltiplicarsi del volume dei dati. Stiamo assistendo a una ristrutturazione fondamentale del modo in cui le aziende approcciano l'infrastruttura.

Un'analisi recente pubblicata dalla MIT Sloan Management Review ha evidenziato esattamente questo cambiamento. Gli editorialisti Thomas H. Davenport e Randy Bean hanno osservato che, invece di costruire enormi data center — un compito generalmente lasciato ai vendor — le aziende che utilizzano queste tecnologie stanno creando "AI factory" interne. Queste fabbriche sono combinazioni di piattaforme tecnologiche, metodi ottimizzati, dati proprietari e algoritmi precedentemente sviluppati che rendono estremamente efficiente la costruzione e l'implementazione di sistemi intelligenti su scala. Standardizzando la pipeline, le organizzazioni possono spingere rapidamente modelli neurali ottimizzati verso l'edge.

Questa infrastruttura localizzata sta guidando massicci cambiamenti economici. Secondo recenti rapporti di mercato, il mercato del software per reti neurali è passato da 31,2 miliardi di dollari nel 2023 a una proiezione di 38,5 miliardi nel 2024, spinto in gran parte dagli sforzi di automazione aziendale e dalla proliferazione di software edge-capable. Come azienda che opera profondamente in questo spazio, NeuralApps osserva questa tendenza in prima persona. Le imprese non si accontentano più di noleggiare intelligenza remota; vogliono possedere e distribuire un'intelligenza locale che risieda direttamente sui dispositivi della flotta.

Gli agenti specializzati superano i sistemi generalisti

Costruire una AI factory richiede decisioni rigorose su quali modelli siano effettivamente necessari. Caricare un enorme modello linguistico generalista su un telefono è altamente inefficiente. I modelli generalisti portano con sé un peso computazionale immenso perché sono addestrati per rispondere a domande su tutto, dalla fisica quantistica alla storia antica. Un tecnico sul campo non ha bisogno che il suo dispositivo scriva poesie; ha bisogno che cataloghi accuratamente un registro di manutenzione.

Al contrario, il settore si sta spostando verso agenti autonomi altamente specializzati. Si tratta di piccole reti neurali, ferocemente ottimizzate, addestrate per eseguire un compito specifico in modo eccezionale. Una recente proiezione di Gartner ha affermato che entro la fine del 2025, il 40% delle applicazioni aziendali includerà agenti IA integrati per compiti specifici. Poiché questi modelli sono leggeri dal punto di vista computazionale, possono risiedere comodamente nei limiti di memoria dell'hardware standard, operando silenziosamente in background per risolvere i problemi dell'utente senza esaurire le risorse del sistema.

Quando si combinano questi piccoli modelli, si crea un ambiente complesso e reattivo. Un agente potrebbe gestire il riconoscimento ottico dei caratteri per la scansione dei documenti, mentre un altro instrada i dati estratti nei campi appropriati del database. Il mio collega Umut Bayrak ha approfondito questo tema nel dettaglio, esplorando la meccanica tecnica dell'integrazione di reti neurali efficienti e agenti localizzati nelle architetture hardware mobili. L'obiettivo è sempre ridurre la distanza tra l'intento dell'utente e l'azione completata.

Un'infrastruttura sostenibile richiede una rigorosa disciplina di prodotto

Il passaggio da una tradizionale architettura dipendente dal cloud a una AI factory edge-first richiede una rigorosa disciplina nello sviluppo. Ogni funzionalità deve giustificare il suo costo computazionale. È facile costruire applicazioni che appaiono impressionanti in una demo in sala riunioni, ma la valutazione del software richiede di guardare come si comporta durante un turno frenetico e ad alta pressione in un piovoso martedì pomeriggio.

Nella scelta o nello sviluppo di queste piattaforme, i leader tecnologici dovrebbero applicare un rigoroso quadro di valutazione. Innanzitutto, determinare la capacità offline: quale percentuale esatta della proposta di valore centrale dell'applicazione funziona senza una connessione internet? In secondo luogo, valutare l'elasticità hardware: l'applicazione riduce gradualmente l'intensità di elaborazione sui dispositivi più vecchi massimizzando al contempo la capacità neurale di quelli più recenti? Infine, valutare l'integrazione del flusso di lavoro: l'intelligenza si inserisce naturalmente nel percorso esistente dell'utente o richiede di abbandonare la schermata attuale per interagire con un'interfaccia conversazionale separata?

Come società di sviluppo software specializzata in queste architetture, la nostra filosofia in NeuralApps è radicata in questa realtà pratica. Crediamo che le esperienze digitali innovative non siano definite dalla complessità dei loro algoritmi sottostanti, ma dalla silenziosità con cui risolvono il problema dell'utente. Quando costruiamo sistemi che rispettano i limiti dell'hardware, riducono al minimo le dipendenze dal cloud e danno priorità all'esecuzione locale, consegniamo software che funziona davvero quando conta di più.