通信ネットワークが完全に遮断された、商業製造施設のコンクリートの地下室に立つフィールドエンジニアを想像してみてください。彼女はモバイルPDFエディタを使用して、500ページに及ぶ膨大な回路図マニュアルから特定の電気安全条項を抽出した上で、複雑な診断ルーチンを実行し、暫定的なコンプライアンスデータを企業のCRMシステムに記録する必要があります。彼女の装備は会社支給のiPhone 11です。一方、その3階上では、サイトマネージャーがiPhone 14 Proで送られてくるデータストリームを監視し、システムの同期を待っています。この環境こそが、現代の人工知能(AI)にとっての真の運用テストです。AIがクリーンなラボ環境で何を達成できるかではなく、日々の商取引における過酷でネットワークから切り離された現実の中で、何を「実行」できるかが問われているのです。

エッジ対応のエンタープライズAIとは、外部のネットワーク接続に関わらず計算処理を継続できるよう、ローカルハードウェア上で最適化されたニューラルネットワークを直接実行する手法です。AIエンジニアとして現場で機能するアーキテクチャを構築してきた6年間で、私はAIの有用性はひとえにこのローカルなレジリエンス(回復力)に依存していることを痛感しました。企業のテクノロジーリーダーや運用ディレクターといった、デジタルエコシステムの主要な設計者たちは、処理能力の高さよりも「アクセシビリティ」の方がはるかに重要であることに気づき始めています。現場向けのシステムを構築するとき、私たちは単にコードを書いているのではありません。ローカルな自律性をエンジニアリングしているのです。

ハードウェアの断片化がもたらす究極のデプロイメントテスト

エンタープライズテクノロジーにおける永続的な現実の一つに、ハードウェアの断片化があります。組織がすべてのデバイスを同時にアップグレードすることは稀です。企業のビジネス環境には、エントリーレベルの旧型デバイス、中位モデルの主力機、そしてプレミアムなフラッグシップモデルが混在し、同時に稼働しています。ハードウェアの最大スペックを前提としたソフトウェア開発は、運用上の失敗への近道でしかありません。

AI搭載モバイルソリューションを開発する際、アーキテクチャはこうしたハードウェアスペックの全域にわたって弾力的にスケーリングする必要があります。ニューラルエンジンや熱制約に制限のある旧型デバイスでも、20分でバッテリーを使い果たすことなくコアな機械学習タスクを実行できなければなりません。逆に、標準のiPhone 14や大画面のiPhone 14 Plusなどの最新ハードウェアで実行される場合は、拡張されたメモリ帯域幅や高速なユニファイドメモリアーキテクチャを直感的に活用し、より複雑なローカル推論を処理すべきです。ソフトウェアは、自身が搭載されているハードウェアを動的に評価し、それに応じて計算負荷を調整する必要があります。

この動的なスケーリングが不可欠なのは、デバイスに関わらずエンドユーザーのワークフローは同一であるべきだからです。技術者はツールが確実に機能することを信頼しています。もし契約分析ツールが文書の要約にクラウド処理を必要とし、そこで技術者が接続を失えば、そのアプリケーションは事実上存在しないも同然となります。最適化されたタスク特化型のモデルをエッジに直接送り込むことで、ネットワークが劣化しても基本的なタスクを維持できるようにするのです。

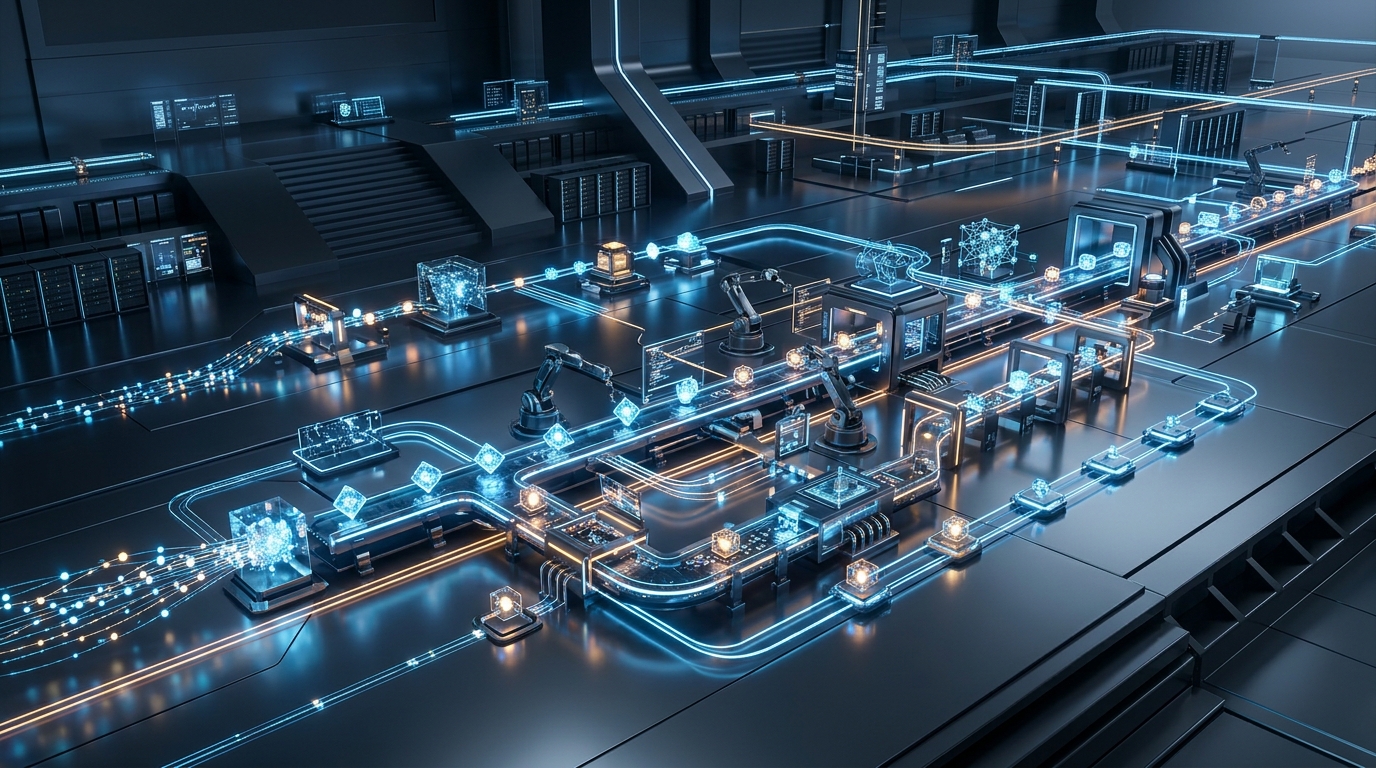

組織内に構築されるローカル処理エコシステム

業界は、「すべてのAIは遠く離れた中央サーバーファームに存在しなければならない」という前提から脱却しつつあります。すべての企業データをサーバーと往復させることによるロジスティックおよびコストのオーバーヘッドは、データ量が増大するにつれて持続不可能になっています。企業のインフラへのアプローチに根本的な再編が起きているのです。

MITスローン・マネジメント・レビューに掲載された最近の分析でも、まさにこの変化が指摘されています。コラムニストのトーマス・H・ダベンポート氏とランディ・ビーン氏は、企業はベンダーに任せきりの大規模データセンターを構築するのではなく、独自の「AIファクトリー(AI工場)」を内部に構築していると述べています。これらのファクトリーは、テクノロジー・プラットフォーム、最適化された手法、独自のデータ、そして開発済みのアルゴリズムを組み合わせたものであり、インテリジェントなシステムを大規模かつ効率的に構築・展開することを可能にします。パイプラインを標準化することで、組織は最適化されたニューラルモデルを迅速にエッジへと送り出すことができるのです。

このローカルインフラへの移行は、大きな経済的変化をもたらしています。最近の市場レポートによると、ニューラルネットワークソフトウェア市場は、企業の自動化の取り組みとエッジ対応ソフトウェアの普及に後押しされ、2023年の312億ドルから2024年には385億ドルに拡大すると予測されています。この分野で深く活動しているNeuralAppsも、このトレンドを肌で感じています。企業はもはやリモートの知能を「借りる」ことだけでは満足していません。自社のデバイス群で直接稼働する、ローカルな知能を「所有し、展開する」ことを望んでいるのです。

タスク特化型エージェントが汎用システムを凌駕する

AIファクトリーを構築するには、どのモデルが本当に必要かを厳格に判断する必要があります。巨大な汎用言語モデルをスマートフォンに詰め込むのは、極めて非効率的です。汎用モデルは、量子物理学から古代史まであらゆる質問に答えるようにトレーニングされているため、膨大な計算負荷を伴います。現場の技術者は、デバイスに詩を書いてもらう必要はありません。メンテナンス記録を正確に分類してほしいだけなのです。

そのため、業界は高度に専門化された自律型エージェントへとシフトしています。これらは、特定のタスク一つを非常に高い精度で実行するために訓練された、小規模で徹底的に最適化されたニューラルネットワークです。ガートナーの最近の予測では、2025年末までにエンタープライズアプリケーションの40%にタスク特化型AIエージェントが組み込まれるとされています。これらのモデルは計算負荷が軽いため、標準的なハードウェアのメモリ制限内に収まり、システムリソースを枯渇させることなくバックグラウンドで静かに動作し、ユーザーの摩擦を解消します。

これらの小さなモデルを組み合わせることで、複雑でレスポンシブな環境が生まれます。あるエージェントがドキュメントスキャンのための光学文字認識(OCR)を処理し、別のエージェントが抽出されたデータを適切なデータベースフィールドにルーティングするといった形です。私の同僚であるUmut Bayrakはこのトピックを詳しく掘り下げ、効率的なニューラルネットワークとローカルエージェントをモバイルハードウェアアーキテクチャに統合するための技術的メカニズムを解説しています。目標は常に、ユーザーの意図と完了したアクションとの間の距離を縮めることにあります。

持続可能なインフラには厳格な製品規律が必要

従来のクラウド依存型アーキテクチャからエッジファーストのAIファクトリーへと移行するには、開発における厳格な規律が必要です。すべての機能は、その計算コストに見合う価値を証明しなければなりません。会議室でのデモンストレーションで見栄えの良いアプリケーションを作るのは簡単ですが、ソフトウェアの真の評価は、雨の火曜日の午後、時間に追われる過酷なシフトの中でどう機能するかで行われるべきです。

これらのプラットフォームを選択または開発する際、テクノロジーリーダーは厳格な評価フレームワークを適用すべきです。第一に「オフライン能力」:アプリケーションのコアバリューの何パーセントが、インターネット接続なしで機能するか。第二に「ハードウェアの弾力性」:古いデバイスでは処理強度を適切に下げ、新しいデバイスではニューラル能力を最大限に活用できるか。最後に「ワークフローの統合」:その知能はユーザーの既存の作業動線の中に自然に組み込まれているか、あるいは別の対話型インターフェースを操作するために現在の画面を離れる必要があるか。

こうしたアーキテクチャを専門とするソフトウェア開発会社として、NeuralAppsの哲学はこの現実的な側面に根ざしています。私たちは、革新的なデジタル体験とは、基礎となるアルゴリズムがいかに複雑であるかではなく、いかに静かにユーザーの課題を解決するかで定義されると考えています。ハードウェアの限界を尊重し、クラウドへの依存を最小限に抑え、ローカルでの実行を優先するシステムを構築することで、最も重要な瞬間に「実際に機能する」ソフトウェアを提供できるのです。