Stellen Sie sich einen Außendiensttechniker vor, der im Betonuntergeschoss einer gewerblichen Fertigungsanlage steht – völlig abgeschnitten von Mobilfunk- und WLAN-Netzen. Sie muss spezifische Klauseln zur elektrischen Sicherheit aus einem dichten, 500-seitigen Handbuch mit einem mobilen PDF-Editor extrahieren, eine komplexe Diagnoseroutine durchführen und die vorläufigen Compliance-Daten im Enterprise-CRM-System protokollieren. Sie ist mit einem vom Unternehmen gestellten iPhone 11 ausgestattet. Drei Stockwerke über ihr überwacht der Standortleiter die eingehenden Datenströme auf einem iPhone 14 Pro und wartet darauf, dass das System synchronisiert wird. Diese Umgebung stellt den wahren operativen Test für moderne künstliche Intelligenz dar. Es geht nicht darum, was Algorithmen unter makellosen Laborbedingungen erreichen können; es geht darum, was sie in der harten, netzunabhängigen Realität des täglichen Geschäftsbetriebs leisten.

Edge-basierte Enterprise-KI ist die Praxis, optimierte neuronale Netze direkt auf lokaler Hardware auszuführen, um eine unterbrechungsfreie Rechenleistung zu gewährleisten, unabhängig von der externen Netzwerkkonnektivität. In meiner sechsjährigen Tätigkeit als KI-Ingenieur, in der ich Architekturen für den Einsatz im Feld entwickelt habe, wurde mir klar, dass der Nutzen vollständig von dieser lokalen Resilienz abhängt. Technologieführer und Betriebsleiter in Unternehmen – die primären Architekten dieser digitalen Ökosysteme – erkennen schnell, dass rohe Rechenleistung weit weniger zählt als die Verfügbarkeit. Wenn wir Systeme für den Außeneinsatz bauen, schreiben wir nicht nur Code; wir konstruieren lokale Autonomie.

Hardware-Fragmentierung als ultimativer Deployment-Test

Eine der beständigsten Realitäten in der Unternehmenstechnologie ist die gemischte Hardware-Flotte. Organisationen rüsten selten alle Geräte gleichzeitig auf. Ein Unternehmens-Ökosystem kann problemlos Legacy-Geräte der Einstiegsklasse, Arbeitstiere der Mittelklasse und Premium-Flaggschiffe enthalten, die alle gleichzeitig in Betrieb sind. Software zu entwickeln, die maximale Hardwarekapazität voraussetzt, ist ein garantierter Weg zum operativen Scheitern.

Bei der Entwicklung KI-gestützter mobiler Lösungen muss die Architektur elastisch über dieses Hardware-Spektrum skalieren. Ein älteres Gerät, das durch seine Neural Engine und thermische Einschränkungen limitiert ist, muss dennoch Kernaufgaben des maschinellen Lernens ausführen können, ohne den Akku in zwanzig Minuten zu leeren. Umgekehrt sollte die Anwendung, wenn sie auf neuerer Hardware wie dem iPhone 14 oder dem iPhone 14 Plus läuft, intuitiv die erweiterten Speicherbandbreiten und schnelleren Unified-Memory-Architekturen nutzen, um komplexere lokale Inferenzen zu verarbeiten. Die Software muss dynamisch die Hardware bewerten, auf der sie läuft, und ihre Rechenlast entsprechend anpassen.

Diese dynamische Skalierung ist entscheidend, da der Workflow für den Endanwender unabhängig vom Gerät identisch bleibt. Der Techniker verlässt sich darauf, dass seine Werkzeuge zuverlässig funktionieren. Wenn ein Tool zur Vertragsanalyse Cloud-Verarbeitung benötigt, um ein Dokument zusammenzufassen, und der Techniker die Verbindung verliert, stellt die Anwendung faktisch ihre Funktion ein. Indem wir optimierte, aufgabenspezifische Modelle direkt an die Edge verlagern, stellen wir sicher, dass grundlegende Prozesse auch bei Netzwerkstörungen bestehen bleiben.

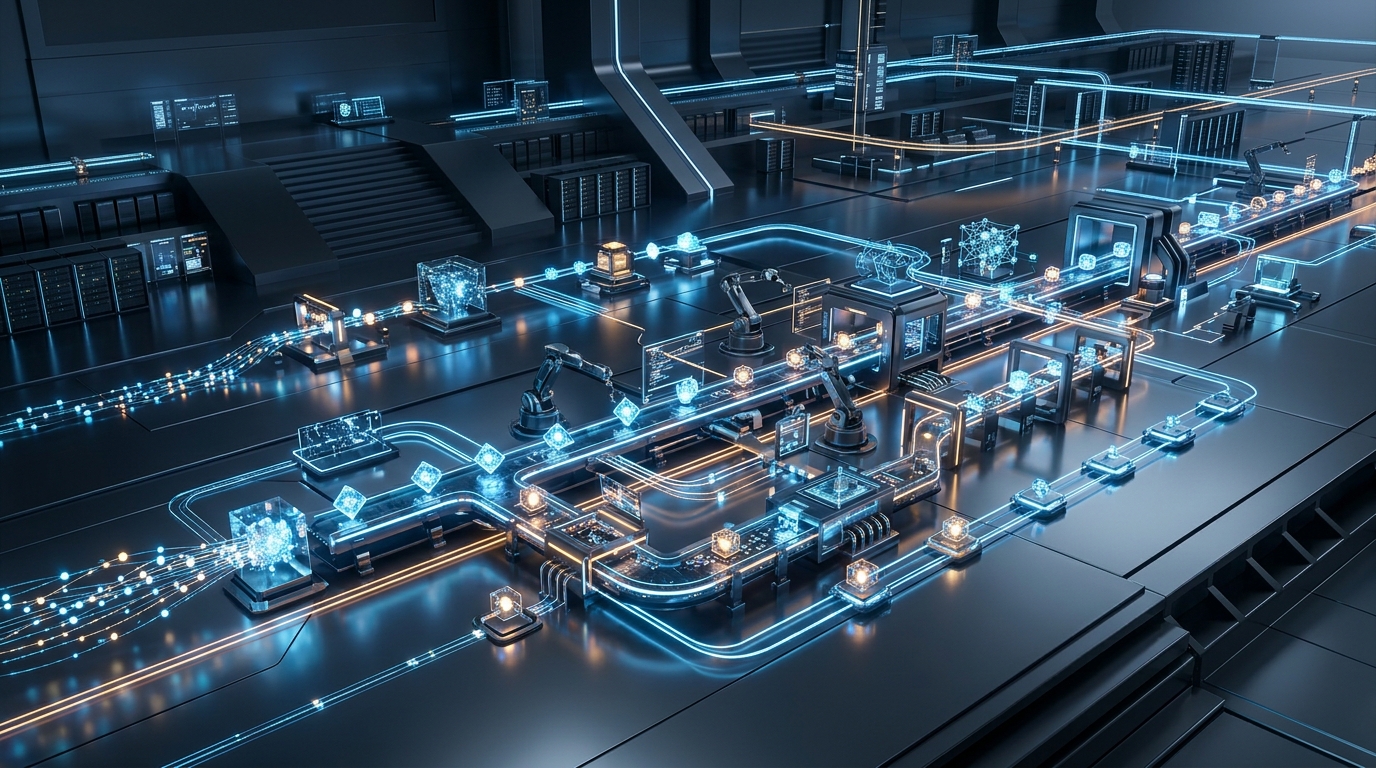

Unternehmen bauen lokale Verarbeitungs-Ökosysteme auf

Die Branche entfernt sich von der Annahme, dass jegliche künstliche Intelligenz in fernen, zentralisierten Serverfarmen leben muss. Der logistische und finanzielle Aufwand für die Übertragung jedes Datenpunktes an einen Server und zurück wird unhaltbar, insbesondere da sich das Datenvolumen vervielfacht. Wir erleben eine fundamentale Umstrukturierung der Art und Weise, wie Unternehmen Infrastruktur angehen.

Eine kürzlich im MIT Sloan Management Review veröffentlichte Analyse hob genau diesen Wandel hervor. Die Kolumnisten Thomas H. Davenport und Randy Bean stellten fest, dass Unternehmen, die diese Technologien nutzen, keine massiven Rechenzentren bauen – eine Aufgabe, die meist Anbietern überlassen wird –, sondern interne „KI-Fabriken“ (AI Factories) errichten. Diese Fabriken sind Kombinationen aus Technologieplattformen, optimierten Methoden, proprietären Daten und bereits entwickelten Algorithmen, die es hocheffizient machen, intelligente Systeme in großem Maßstab zu bauen und einzusetzen. Durch die Standardisierung der Pipeline können Unternehmen optimierte neuronale Modelle schnell an die Edge ausrollen.

Diese lokale Infrastruktur treibt massive wirtschaftliche Verschiebungen voran. Jüngsten Marktberichten zufolge wuchs der Markt für neuronale Netzwerksoftware von 31,2 Milliarden US-Dollar im Jahr 2023 auf prognostizierte 38,5 Milliarden US-Dollar im Jahr 2024, was größtenteils auf Automatisierungsbemühungen in Unternehmen und die Verbreitung Edge-fähiger Software zurückzuführen ist. Als Unternehmen, das tief in diesem Bereich tätig ist, beobachtet NeuralApps diesen Trend aus erster Hand. Unternehmen geben sich nicht mehr damit zufrieden, Remote-Intelligenz zu mieten; sie wollen lokale Intelligenz besitzen und einsetzen, die direkt auf ihren Flottengeräten lebt.

Aufgabenspezifische Agenten schlagen generalisierte Systeme

Der Aufbau einer KI-Fabrik erfordert strikte Entscheidungen darüber, welche Modelle tatsächlich notwendig sind. Ein massives, generalisiertes Sprachmodell auf ein Telefon zu bringen, ist höchst ineffizient. Generalisierte Modelle tragen eine enorme Rechenlast, da sie darauf trainiert sind, Fragen zu allem Möglichen zu beantworten – von Quantenphysik bis hin zu antiker Geschichte. Ein Außendiensttechniker braucht kein Gerät, das Gedichte schreibt; er braucht eines, das ein Wartungsprotokoll präzise kategorisiert.

Stattdessen verlagert sich die Branche hin zu hochspezialisierten, autonomen Agenten. Dabei handelt es sich um kleine, extrem optimierte neuronale Netze, die darauf trainiert sind, eine ganz bestimmte Aufgabe hervorragend auszuführen. Eine aktuelle Gartner-Prognose besagt, dass bis Ende 2025 40 % der Unternehmensanwendungen eingebettete, aufgabenspezifische KI-Agenten enthalten werden. Da diese Modelle rechenarm sind, können sie problemlos innerhalb der Speicherbeschränkungen von Standard-Hardware arbeiten und geräuschlos im Hintergrund agieren, um Reibungspunkte für den Benutzer zu lösen, ohne die Systemressourcen zu erschöpfen.

Wenn man diese kleinen Modelle kombiniert, entsteht eine komplexe, reaktionsschnelle Umgebung. Ein Agent übernimmt beispielsweise die optische Zeichenerkennung für das Scannen von Dokumenten, während ein anderer die extrahierten Daten in die entsprechenden Datenbankfelder leitet. Mein Kollege Umut Bayrak hat dieses Thema im Detail beleuchtet und die technischen Mechanismen zur Integration effizienter neuronaler Netze und lokaler Agenten in mobile Hardware-Architekturen untersucht. Das Ziel ist es immer, die Distanz zwischen der Absicht des Nutzers und der ausgeführten Aktion zu verringern.

Nachhaltige Infrastruktur erfordert strikte Produktdisziplin

Der Übergang von einer traditionellen, cloud-abhängigen Architektur zu einer Edge-First-KI-Fabrik erfordert rigorose Disziplin in der Entwicklung. Jedes Feature muss seine Rechenkosten rechtfertigen. Es ist einfach, Anwendungen zu bauen, die in einer Vorstandspräsentation beeindruckend aussehen, aber die Bewertung von Software erfordert einen Blick darauf, wie sie während einer hektischen, stressigen Schicht an einem verregneten Dienstagnachmittag performt.

Bei der Auswahl oder Entwicklung dieser Plattformen sollten Technologieführer ein strenges Bewertungsraster anwenden. Bestimmen Sie erstens die Offline-Fähigkeit: Welcher exakte Prozentsatz des Kern-Wertversprechens der Anwendung funktioniert ohne Internetverbindung? Bewerten Sie zweitens die Hardware-Elastizität: Reduziert die Anwendung ihre Verarbeitungsintensität auf älteren Geräten anmutig, während sie die neuronale Kapazität neuerer Geräte maximiert? Prüfen Sie schließlich die Workflow-Integration: Sitzt die Intelligenz natürlich im bestehenden Pfad des Benutzers oder erfordert sie, dass er seinen aktuellen Bildschirm verlässt, um mit einer separaten Konversationsschnittstelle zu interagieren?

Als Softwareentwicklungsunternehmen, das auf diese Architekturen spezialisiert ist, wurzelt unsere Philosophie bei NeuralApps in dieser praktischen Realität. Wir glauben, dass innovative digitale Erlebnisse nicht dadurch definiert werden, wie komplex ihre zugrunde liegenden Algorithmen sind, sondern wie geräuschlos sie das Problem des Benutzers lösen. Wenn wir Systeme bauen, die Hardware-Limits respektieren, Cloud-Abhängigkeiten minimieren und die lokale Ausführung priorisieren, liefern wir Software, die tatsächlich funktioniert, wenn es am wichtigsten ist.