Imaginez une ingénieure de terrain dans le sous-sol en béton d’un site de production industrielle, totalement coupée des réseaux cellulaires et Wi-Fi. Elle doit extraire des clauses de sécurité électrique spécifiques d'un manuel de schémas dense de 500 pages à l'aide d'un éditeur PDF mobile, exécuter une routine de diagnostic complexe et consigner les données de conformité préliminaires dans le CRM de l'entreprise. Elle est équipée d'un iPhone 11 fourni par sa société. Trois étages plus haut, le chef de chantier surveille les flux de données entrants sur un iPhone 14 Pro, en attendant que le système se synchronise. Cet environnement représente le véritable test opérationnel pour l'intelligence artificielle moderne. Il ne s'agit pas de ce que les algorithmes peuvent accomplir dans les conditions immaculées d'un laboratoire, mais de ce qu'ils peuvent exécuter dans les réalités rudes et déconnectées du commerce quotidien.

L'IA d'entreprise optimisée pour la mobilité consiste à faire tourner des réseaux neuronaux directement sur le matériel local afin de garantir un traitement informatique ininterrompu, quelle que soit la connectivité réseau externe. En six ans de carrière en tant qu'ingénieur en IA, à concevoir des architectures opérationnelles sur le terrain, j'ai réalisé que l'utilité dépend entièrement de cette résilience locale. Les directeurs technologiques et les responsables des opérations — les principaux architectes de ces écosystèmes numériques — réalisent rapidement que la puissance de calcul brute importe bien moins que l'accessibilité. Lorsque nous concevons des systèmes pour le terrain, nous ne nous contentons pas d'écrire du code ; nous forgeons une autonomie locale.

La fragmentation matérielle : l'épreuve ultime du déploiement

L'une des réalités les plus persistantes de la technologie en entreprise est l'hétérogénéité du parc matériel. Les organisations ne mettent que rarement à jour tous leurs appareils simultanément. Un écosystème d'entreprise peut facilement regrouper des appareils d'entrée de gamme vieillissants, des modèles de milieu de gamme robustes et des fleurons haut de gamme, tous fonctionnant en même temps. Développer un logiciel qui suppose une capacité matérielle maximale est le chemin le plus court vers l'échec opérationnel.

Lors du développement de solutions mobiles basées sur l'IA, l'architecture doit s'adapter de manière élastique à ce spectre matériel. Un appareil plus ancien, limité par son moteur neuronal et ses contraintes thermiques, doit toujours pouvoir exécuter des tâches d'apprentissage automatique de base sans vider la batterie en vingt minutes. À l'inverse, lorsque l'application s'exécute sur un matériel plus récent, tel qu'un iPhone 14 standard ou un iPhone 14 Plus à écran large, elle doit intuitivement exploiter la bande passante mémoire étendue et les architectures de mémoire unifiée plus rapides pour traiter des inférences locales plus complexes. Le logiciel doit évaluer dynamiquement le matériel sur lequel il réside et ajuster sa charge de calcul en conséquence.

Cette mise à l'échelle dynamique est cruciale car le flux de travail de l'utilisateur final reste identique quel que soit l'appareil. Le technicien compte sur ses outils pour fonctionner de manière fiable. Si un outil d'analyse de contrat nécessite un traitement cloud pour résumer un document et que le technicien perd sa connexion, l'application cesse purement et simplement d'exister. En poussant des modèles optimisés et spécifiques à une tâche directement en local (« à la périphérie »), nous garantissons que les fonctions fondamentales survivent à la dégradation du réseau.

Les organisations bâtissent des écosystèmes de traitement localisés

L'industrie s'éloigne de l'idée selon laquelle toute l'intelligence artificielle doit résider dans des fermes de serveurs distantes et centralisées. Les coûts logistiques et financiers liés à la transmission de chaque donnée d'entreprise vers un serveur deviennent insoutenables, surtout avec l'explosion du volume de données. Nous assistons à une restructuration fondamentale de l'approche des entreprises vis-à-vis de leur infrastructure.

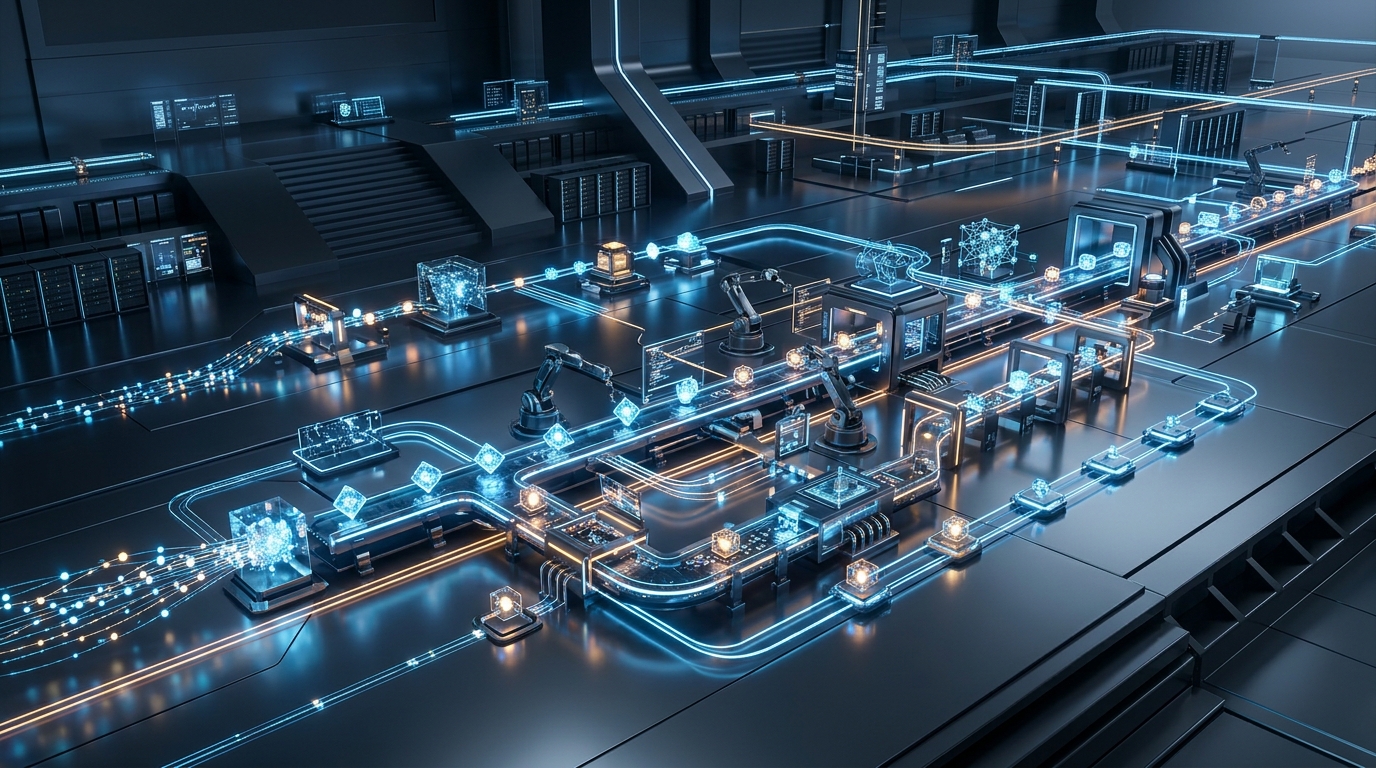

Une analyse récente publiée dans la MIT Sloan Management Review souligne exactement ce virage. Les chroniqueurs Thomas H. Davenport et Randy Bean ont noté qu'au lieu de construire d'énormes centres de données — une tâche généralement laissée aux fournisseurs — les entreprises utilisatrices créent des « usines d'IA » internes. Ces usines combinent des plateformes technologiques, des méthodes optimisées, des données propriétaires et des algorithmes pré-développés qui permettent de construire et de déployer des systèmes intelligents à grande échelle de manière très efficace. En standardisant ce pipeline, les organisations peuvent rapidement déployer des modèles neuronaux optimisés sur le terrain.

Cette infrastructure localisée entraîne des changements économiques majeurs. Selon des rapports de marché récents, le marché des logiciels de réseaux neuronaux est passé de 31,2 milliards de dollars en 2023 à une projection de 38,5 milliards de dollars en 2024, porté en grande partie par les efforts d'automatisation des entreprises et la prolifération de logiciels capables de fonctionner en local. En tant que cabinet opérant au cœur de ce secteur, NeuralApps observe cette tendance de première main. Les entreprises ne se contentent plus de louer une intelligence distante ; elles veulent posséder et déployer une intelligence localisée qui réside directement sur leurs appareils de flotte.

Des agents spécialisés plus agiles que les systèmes généralistes

Construire une usine d'IA nécessite de prendre des décisions strictes sur les modèles réellement nécessaires. Vouloir faire tourner un modèle de langage massif et généraliste sur un téléphone est inefficace. Les modèles généralistes sont lourds informatiquement car ils sont entraînés pour répondre à tout, de la physique quantique à l'histoire ancienne. Un technicien de terrain n'a pas besoin que son appareil écrive de la poésie ; il a besoin qu'il catégorise avec précision un rapport de maintenance.

Au lieu de cela, l'industrie se tourne vers des agents autonomes hautement spécialisés. Il s'agit de petits réseaux neuronaux férocement optimisés, entraînés pour exécuter une tâche spécifique de manière exceptionnelle. Une projection de Gartner indique que d'ici la fin de 2025, 40 % des applications d'entreprise intégreront des agents d'IA spécialisés. Comme ces modèles sont légers, ils s'insèrent confortablement dans les contraintes de mémoire du matériel standard, fonctionnant discrètement en arrière-plan pour fluidifier l'expérience utilisateur sans drainer les ressources du système.

En combinant ces petits modèles, vous créez un environnement complexe et réactif. Un agent peut gérer la reconnaissance optique de caractères pour la numérisation de documents, tandis qu'un autre dirige les données extraites vers les bons champs de la base de données. Mon collègue Umut Bayrak a abordé ce sujet en détail, en explorant les mécanismes techniques de l'intégration de réseaux neuronaux efficaces et d'agents localisés dans les architectures matérielles mobiles. L'objectif est toujours de réduire la distance entre l'intention de l'utilisateur et l'action accomplie.

Une infrastructure durable exige une discipline produit rigoureuse

Passer d'une architecture traditionnelle dépendante du cloud à une « usine d'IA » axée sur le traitement local exige une discipline de développement rigoureuse. Chaque fonctionnalité doit justifier son coût informatique. Il est facile de créer des applications impressionnantes lors d'une démonstration en salle de conférence, mais l'évaluation d'un logiciel doit se faire sur sa performance lors d'une intervention tendue et sous haute pression, un mardi après-midi pluvieux.

Lors de la sélection ou du développement de ces plateformes, les leaders technologiques doivent appliquer un cadre d'évaluation strict. Premièrement, déterminez la capacité hors ligne : quel pourcentage exact de la valeur ajoutée de l'application fonctionne sans connexion internet ? Deuxièmement, évaluez l'élasticité matérielle : l'application réduit-elle gracieusement son intensité de traitement sur les anciens appareils tout en maximisant la capacité neuronale des plus récents ? Enfin, évaluez l'intégration au workflow : l'intelligence s'insère-t-elle naturellement dans le parcours de l'utilisateur, ou l'oblige-t-elle à abandonner son écran actuel pour interagir avec une interface conversationnelle distincte ?

En tant qu'entreprise de développement logiciel spécialisée dans ces architectures, notre philosophie chez NeuralApps est ancrée dans cette réalité pratique. Nous pensons que les expériences numériques innovantes ne se définissent pas par la complexité de leurs algorithmes, mais par la discrétion avec laquelle elles résolvent le problème de l'utilisateur. En construisant des systèmes qui respectent les limites du matériel, minimisent les dépendances au cloud et privilégient l'exécution locale, nous livrons des logiciels qui fonctionnent réellement quand cela compte le plus.