Imagine a una ingeniera de campo en el sótano de concreto de una planta de fabricación comercial, completamente aislada de las redes celulares e inalámbricas. Necesita extraer cláusulas específicas de seguridad eléctrica de un denso manual de esquemas de 500 páginas mediante un editor de PDF móvil, ejecutar una rutina de diagnóstico compleja y registrar los datos preliminares de cumplimiento en el sistema CRM de la empresa. Está equipada con un iPhone 11 proporcionado por la compañía. Tres pisos arriba, el gerente del sitio monitorea los flujos de datos entrantes en un iPhone 14 Pro, esperando a que el sistema se sincronice. Este entorno representa la verdadera prueba operativa para la inteligencia artificial moderna. No se trata de lo que los algoritmos pueden lograr en condiciones de laboratorio impecables; se trata de lo que pueden ejecutar en las realidades duras y desconectadas del comercio diario.

La IA empresarial habilitada en el borde (edge computing) es la práctica de ejecutar redes neuronales optimizadas directamente en el hardware local para garantizar un procesamiento computacional ininterrumpido, independientemente de la conectividad de red externa. En mis seis años trabajando como ingeniero de IA, construyendo arquitecturas que funcionan en el campo, me he dado cuenta de que la utilidad depende totalmente de esta resiliencia localizada. Los líderes de tecnología empresarial y directores de operaciones —los arquitectos principales de estos ecosistemas digitales— se están dando cuenta rápidamente de que la potencia de procesamiento bruta importa mucho menos que la accesibilidad. Cuando construimos sistemas para el campo, no solo escribimos código; estamos diseñando autonomía localizada.

La fragmentación del hardware crea la prueba de despliegue definitiva

Una de las realidades más persistentes en la tecnología empresarial es la flota de hardware mixto. Las organizaciones rara vez actualizan todos los dispositivos simultáneamente. Un ecosistema corporativo puede contener fácilmente dispositivos heredados de nivel de entrada, terminales de gama media y buques insignia premium operando simultáneamente. Desarrollar software que asuma la máxima capacidad de hardware es un camino garantizado al fracaso operativo.

Al desarrollar soluciones móviles impulsadas por IA, la arquitectura debe escalar de forma elástica a través de este espectro de hardware. Un dispositivo más antiguo, limitado por su motor neuronal y restricciones térmicas, aún necesita ejecutar tareas básicas de aprendizaje automático sin agotar la batería en veinte minutos. Por el contrario, cuando la aplicación se ejecuta en hardware más nuevo, como el iPhone 14 estándar o el iPhone 14 Plus de pantalla grande, debería aprovechar intuitivamente el mayor ancho de banda de memoria y las arquitecturas de memoria unificada más rápidas para procesar inferencias locales más complejas. El software debe evaluar dinámicamente el hardware en el que reside y ajustar su carga computacional en consecuencia.

Este escalado dinámico es crítico porque el flujo de trabajo del usuario final sigue siendo idéntico independientemente del dispositivo. El técnico confía en que sus herramientas funcionen de manera fiable. Si una herramienta de análisis de contratos requiere procesamiento en la nube para resumir un documento y el técnico pierde la conexión, la aplicación efectivamente deja de existir. Al llevar modelos optimizados y específicos para cada tarea directamente al borde, garantizamos que las tareas fundamentales sobrevivan a la degradación de la red.

Las organizaciones construyen ecosistemas de procesamiento localizado

La industria se está alejando de la suposición de que toda la inteligencia artificial debe vivir en granjas de servidores centralizadas y distantes. La sobrecarga logística y financiera de transmitir cada dato empresarial de ida y vuelta a un servidor se está volviendo insostenible, especialmente a medida que el volumen de datos se multiplica. Estamos viendo una reestructuración fundamental en la forma en que las empresas abordan la infraestructura.

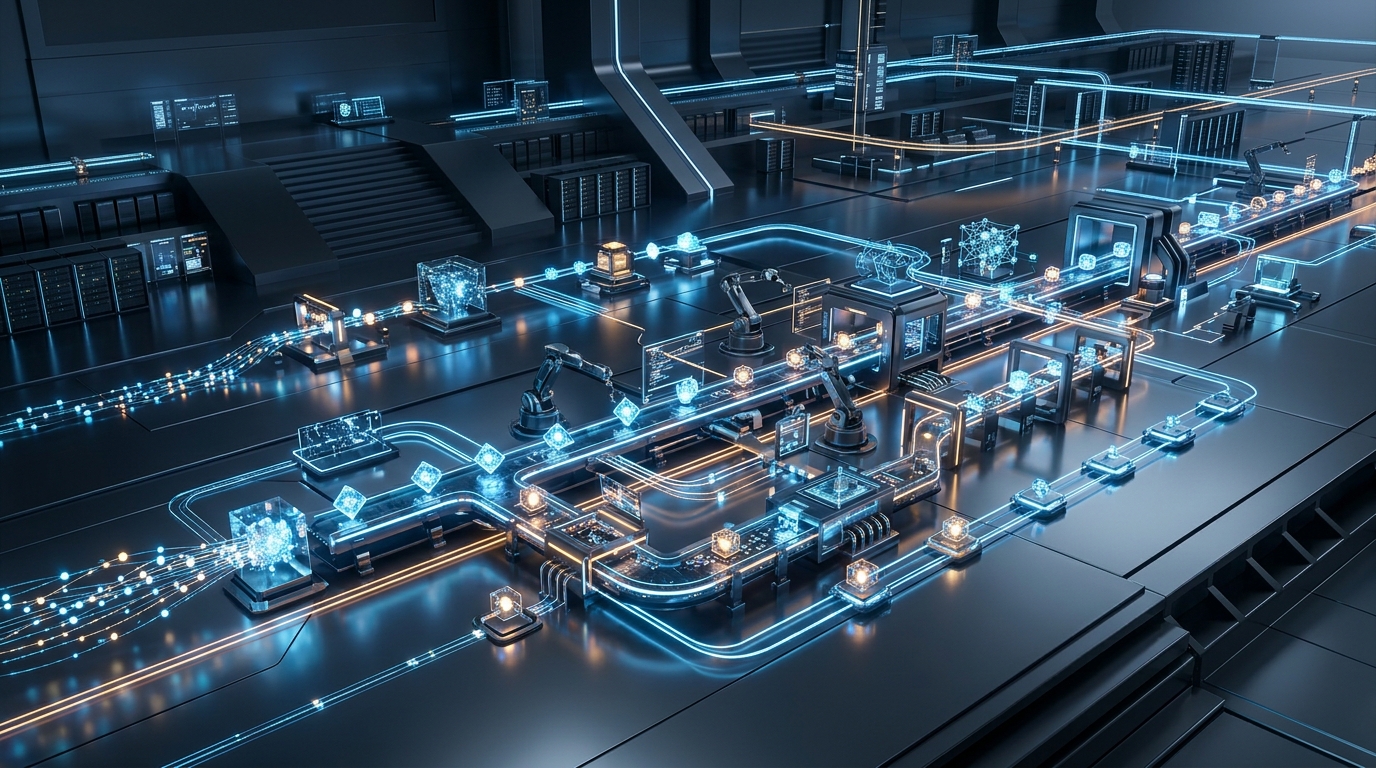

Un análisis reciente publicado en la MIT Sloan Management Review destacó exactamente este cambio. Los columnistas Thomas H. Davenport y Randy Bean señalaron que, en lugar de construir centros de datos masivos —una tarea que generalmente se deja a los proveedores—, las empresas que utilizan estas tecnologías están creando "fábricas de IA" internas. Estas fábricas son combinaciones de plataformas tecnológicas, métodos optimizados, datos patentados y algoritmos desarrollados previamente que hacen que sea altamente eficiente construir y desplegar sistemas inteligentes a escala. Al estandarizar el flujo de trabajo, las organizaciones pueden enviar rápidamente modelos neuronales optimizados hacia el borde.

Esta infraestructura localizada está impulsando cambios económicos masivos. Según informes de mercado recientes, el mercado de software de redes neuronales se expandió de 31.2 mil millones de dólares en 2023 a una proyección de 38.5 mil millones de dólares en 2024, impulsado en gran medida por los esfuerzos de automatización empresarial y la proliferación de software con capacidad de ejecución en el borde. Como firma que opera profundamente en este espacio, NeuralApps observa esta tendencia de primera mano. Las empresas ya no se conforman con alquilar inteligencia remota; quieren poseer y desplegar inteligencia localizada que viva directamente en sus dispositivos de flota.

Los agentes especializados superan a los sistemas generalizados

Construir una fábrica de IA requiere tomar decisiones estrictas sobre qué modelos son realmente necesarios. Intentar integrar un modelo de lenguaje masivo y generalizado en un teléfono es altamente ineficiente. Los modelos generalizados conllevan un peso computacional inmenso porque están entrenados para responder preguntas sobre todo, desde física cuántica hasta historia antigua. Un técnico de campo no necesita que su dispositivo escriba poesía; necesita que categorice con precisión un registro de mantenimiento.

En su lugar, la industria se está desplazando hacia agentes autónomos altamente especializados. Se trata de redes neuronales pequeñas y ferozmente optimizadas, entrenadas para ejecutar una tarea muy específica excepcionalmente bien. Una proyección reciente de Gartner afirmó que, para finales de 2025, el 40% de las aplicaciones empresariales contarán con agentes de IA integrados específicos para tareas. Debido a que estos modelos son computacionalmente ligeros, pueden residir cómodamente dentro de las limitaciones de memoria del hardware estándar, operando silenciosamente en segundo plano para resolver la fricción del usuario sin agotar los recursos del sistema.

Cuando se combinan estos modelos pequeños, se crea un entorno complejo y receptivo. Un agente puede encargarse del reconocimiento óptico de caracteres para el escaneo de documentos, mientras que otro enruta los datos extraídos a los campos correspondientes de la base de datos. Mi colega Umut Bayrak abordó este tema en detalle, explorando la mecánica técnica de la integración de redes neuronales eficientes y agentes localizados en arquitecturas de hardware móvil. El objetivo es siempre reducir la distancia entre la intención del usuario y la acción completada.

Una infraestructura sostenible requiere una disciplina de producto estricta

La transición de una arquitectura tradicional dependiente de la nube a una fábrica de IA que prioriza el borde requiere una disciplina rigurosa en el desarrollo. Cada función debe justificar su costo computacional. Es fácil construir aplicaciones que parezcan impresionantes en una demostración en la sala de juntas, pero evaluar el software requiere observar cómo se desempeña durante un turno frenético y de alta presión un martes lluvioso por la tarde.

Al seleccionar o desarrollar estas plataformas, los líderes tecnológicos deben aplicar un marco de evaluación estricto. Primero, determinar la capacidad fuera de línea: ¿qué porcentaje exacto de la propuesta de valor principal de la aplicación funciona sin conexión a Internet? Segundo, evaluar la elasticidad del hardware: ¿degrada la aplicación con elegancia su intensidad de procesamiento en dispositivos antiguos mientras maximiza la capacidad neuronal de los nuevos? Finalmente, evaluar la integración del flujo de trabajo: ¿la inteligencia se sitúa de forma natural en la ruta existente del usuario, o requiere que este abandone su pantalla actual para interactuar con una interfaz conversacional independiente?

Como firma de desarrollo de software especializada en estas arquitecturas, nuestra filosofía en NeuralApps se basa en esta realidad práctica. Creemos que las experiencias digitales innovadoras no se definen por la complejidad de sus algoritmos subyacentes, sino por la discreción con la que resuelven el problema del usuario. Cuando construimos sistemas que respetan los límites del hardware, minimizan las dependencias de la nube y priorizan la ejecución localizada, entregamos software que realmente funciona cuando más importa.