Wyobraźmy sobie inżynierkę terenową stojącą w betonowym podziemiu zakładu produkcyjnego, całkowicie odciętą od sieci komórkowych i Wi-Fi. Musi ona wyodrębnić konkretne klauzule dotyczące bezpieczeństwa elektrycznego z obszernej, 500-stronicowej instrukcji schematycznej za pomocą mobilnego edytora PDF, przeprowadzić złożoną procedurę diagnostyczną i zarejestrować wstępne dane dotyczące zgodności w korporacyjnym systemie CRM. Jest wyposażona w służbowego iPhone'a 11. Trzy piętra wyżej kierownik zakładu monitoruje przychodzące strumienie danych na iPhone'ie 14 Pro, czekając na synchronizację systemu. Takie środowisko stanowi prawdziwy test operacyjny dla nowoczesnej sztucznej inteligencji. Nie chodzi o to, co algorytmy mogą osiągnąć w sterylnych warunkach laboratoryjnych; chodzi o to, co są w stanie wykonać w surowych, pozbawionych łączności realiach codziennego biznesu.

Sztuczna inteligencja w przedsiębiorstwach oparta na przetwarzaniu krawędziowym (edge AI) to praktyka uruchamiania zoptymalizowanych sieci neuronowych bezpośrednio na lokalnym sprzęcie. Zapewnia to nieprzerwane przetwarzanie obliczeniowe, niezależnie od zewnętrznej łączności sieciowej. Przez sześć lat pracy jako inżynier AI, tworząc architektury funkcjonujące w terenie, zdałem sobie sprawę, że użyteczność systemów zależy całkowicie od tej lokalnej odporności. Liderzy technologii korporacyjnych i dyrektorzy operacyjni – główni architekci tych cyfrowych ekosystemów – szybko zauważają, że surowa moc obliczeniowa ma znacznie mniejsze znaczenie niż dostępność. Budując systemy dla użytkowników terenowych, nie tylko piszemy kod; projektujemy lokalną autonomię.

Fragmentacja sprzętowa jako ostateczny test wdrożeniowy

Jedną z najbardziej uporczywych realiów w technologii korporacyjnej jest mieszana flota sprzętowa. Organizacje rzadko wymieniają wszystkie urządzenia jednocześnie. Ekosystem korporacyjny może z łatwością zawierać podstawowe urządzenia starszej generacji, średniej klasy modele robocze oraz flagowce premium, pracujące jednocześnie. Tworzenie oprogramowania zakładającego maksymalną wydajność sprzętową to prosta droga do operacyjnej porażki.

Podczas opracowywania rozwiązań mobilnych opartych na AI, architektura musi skalować się elastycznie w całym spektrum sprzętowym. Starsze urządzenie, ograniczone przez silnik neuronowy (Neural Engine) i limity termiczne, nadal musi wykonywać kluczowe zadania uczenia maszynowego bez rozładowania baterii w dwadzieścia minut. Z kolei gdy aplikacja działa na nowszym sprzęcie, takim jak standardowy iPhone 14 czy iPhone 14 Plus, powinna intuicyjnie korzystać ze zwiększonej przepustowości i szybszej architektury pamięci zunifikowanej, aby przetwarzać bardziej złożone lokalne wnioskowania. Oprogramowanie musi dynamicznie oceniać sprzęt, na którym się znajduje, i odpowiednio dostosowywać obciążenie obliczeniowe.

To dynamiczne skalowanie jest krytyczne, ponieważ proces pracy użytkownika końcowego pozostaje identyczny niezależnie od urządzenia. Technik polega na swoich narzędziach, które muszą działać niezawodnie. Jeśli narzędzie do analizy umów wymaga przetwarzania w chmurze do podsumowania dokumentu, a technik straci łączność, aplikacja praktycznie przestaje istnieć. Przenosząc zoptymalizowane, specyficzne dla zadań modele bezpośrednio na krawędź (edge), zapewniamy, że fundamentalne funkcje przetrwają spadek jakości sieci.

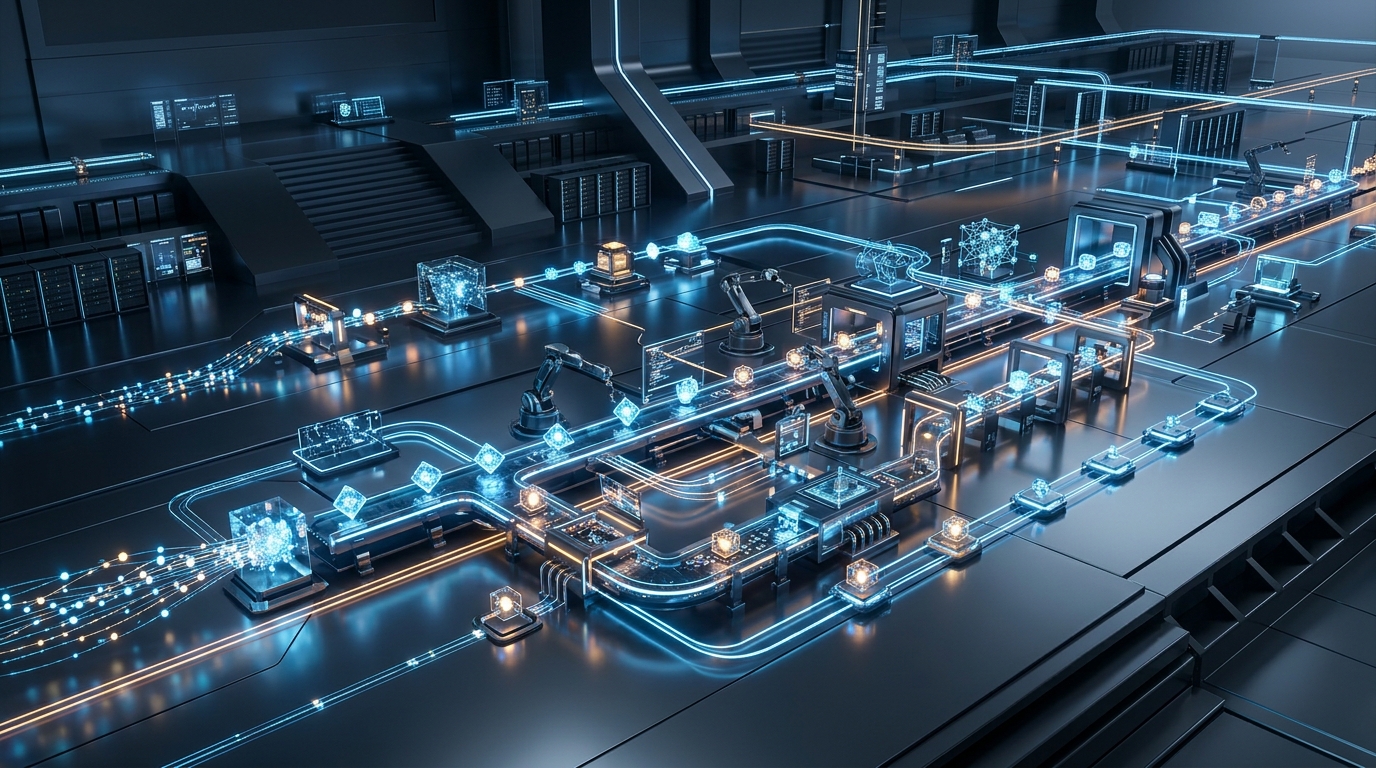

Organizacje budują lokalne ekosystemy przetwarzania

Branża odchodzi od założenia, że każda sztuczna inteligencja musi rezydować w odległych, scentralizowanych farmach serwerów. Koszty logistyczne i finansowe przesyłania każdego bajtu danych korporacyjnych do serwera i z powrotem stają się nie do utrzymania, zwłaszcza gdy objętość danych rośnie lawinowo. Obserwujemy fundamentalną restrukturyzację podejścia firm do infrastruktury.

Niedawna analiza opublikowana w MIT Sloan Management Review podkreśliła tę zmianę. Felietoniści Thomas H. Davenport i Randy Bean zauważyli, że zamiast budować masywne centra danych – zadanie zazwyczaj pozostawiane dostawcom – firmy korzystające z tych technologii tworzą wewnętrzne „fabryki AI”. Fabryki te są połączeniem platform technologicznych, zoptymalizowanych metod, zastrzeżonych danych i wcześniej opracowanych algorytmów, które pozwalają na wysoce wydajne budowanie i wdrażanie inteligentnych systemów na dużą skalę. Dzięki standaryzacji tego procesu, organizacje mogą błyskawicznie wypychać zoptymalizowane modele neuronowe na urządzenia brzegowe.

Ta lokalna infrastruktura napędza ogromne zmiany ekonomiczne. Według najnowszych raportów rynkowych, rynek oprogramowania opartego na sieciach neuronowych wzrósł z 31,2 mld USD w 2023 roku do prognozowanych 38,5 mld USD w 2024 roku, co jest napędzane głównie przez wysiłki w zakresie automatyzacji przedsiębiorstw i upowszechnienie oprogramowania zdolnego do pracy na brzegu sieci. Jako firma działająca głęboko w tym obszarze, NeuralApps obserwuje ten trend z pierwszej ręki. Przedsiębiorstwa nie chcą już wynajmować zdalnej inteligencji; chcą posiadać i wdrażać lokalną inteligencję, która żyje bezpośrednio na ich flocie urządzeń.

Wyspecjalizowani agenci wygrywają z systemami ogólnymi

Budowa fabryki AI wymaga podejmowania surowych decyzji o tym, które modele są faktycznie niezbędne. Wpychanie potężnego, ogólnego modelu językowego do telefonu jest wysoce nieefektywne. Modele ogólne niosą ze sobą ogromny ciężar obliczeniowy, ponieważ są szkolone, by odpowiadać na pytania o wszystko – od fizyki kwantowej po historię starożytną. Technik terenowy nie potrzebuje, aby jego urządzenie pisało wiersze; potrzebuje, aby dokładnie skategoryzowało rekord konserwacji.

Zamiast tego branża zmierza w stronę wysoce wyspecjalizowanych, autonomicznych agentów. Są to małe, agresywnie zoptymalizowane sieci neuronowe wyszkolone do wykonywania jednego konkretnego zadania w sposób wyjątkowy. Według prognoz Gartnera, do końca 2025 roku 40% aplikacji korporacyjnych będzie posiadało wbudowane, wyspecjalizowane agenty AI. Ponieważ modele te są lekkie obliczeniowo, mogą swobodnie mieścić się w ograniczeniach pamięci standardowego sprzętu, działając dyskretnie w tle, aby rozwiązywać problemy użytkownika bez nadmiernego obciążania zasobów systemu.

Łącząc te małe modele, tworzy się złożone, responsywne środowisko. Jeden agent może obsługiwać optyczne rozpoznawanie znaków (OCR) przy skanowaniu dokumentów, podczas gdy inny przesyła wyodrębnione dane do odpowiednich pól bazy danych. Mój kolega Umut Bayrak szczegółowo omówił ten temat, badając techniczne mechanizmy integracji wydajnych sieci neuronowych i lokalnych agentów w mobilnych architekturach sprzętowych. Celem jest zawsze skrócenie dystansu między intencją użytkownika a wykonanym działaniem.

Zrównoważona infrastruktura wymaga dyscypliny produktowej

Przejście z tradycyjnej architektury opartej na chmurze do fabryki AI typu „edge-first” wymaga rygorystycznej dyscypliny w rozwoju. Każda funkcja musi uzasadnić swój koszt obliczeniowy. Łatwo jest budować aplikacje, które wyglądają imponująco podczas prezentacji w sali konferencyjnej, ale ocena oprogramowania wymaga sprawdzenia, jak radzi sobie ono podczas gorączkowej, stresującej zmiany w deszczowe, wtorkowe popołudnie.

Wybierając lub rozwijając te platformy, liderzy technologii powinni stosować ścisłe ramy oceny. Po pierwsze, należy określić zdolność do pracy offline: jaki dokładnie procent głównej wartości aplikacji funkcjonuje bez połączenia z Internetem? Po drugie, należy ocenić elastyczność sprzętową: czy aplikacja płynnie obniża intensywność przetwarzania na starszych urządzeniach, jednocześnie maksymalizując potencjał neuronowy nowszych? Wreszcie, należy ocenić integrację z procesem pracy: czy inteligencja naturalnie wpisuje się w ścieżkę użytkownika, czy wymaga od niego porzucenia bieżącego ekranu na rzecz interakcji z osobnym interfejsem konwersacyjnym?

Jako firma programistyczna specjalizująca się w tych architekturach, nasza filozofia w NeuralApps jest zakorzeniona w tej praktycznej rzeczywistości. Wierzymy, że innowacyjne doświadczenia cyfrowe nie są definiowane przez to, jak złożone są ich podstawowe algorytmy, ale przez to, jak dyskretnie rozwiązują problemy użytkownika. Budując systemy szanujące ograniczenia sprzętowe, minimalizujące zależność od chmury i priorytetyzujące lokalne wykonywanie zadań, dostarczamy oprogramowanie, które naprawdę działa wtedy, gdy ma to największe znaczenie.