Föreställ dig en fältingenjör som står i en betongkällare i en kommersiell tillverkningsanläggning, helt utan täckning för mobilnät eller Wi-Fi. Hon behöver extrahera specifika elsäkerhetsklausuler från en omfattande, 500-sidig teknisk manual med hjälp av en mobil pdf-redigerare, utföra en komplex diagnostikrutin och logga preliminära efterlevnadsdata i företagets CRM-system. Hon är utrustad med en iPhone 11 som företaget tillhandahållit. Tre våningar ovanför henne övervakar platschefen inkommande dataströmmar på en iPhone 14 Pro i väntan på att systemet ska synkroniseras. Denna miljö representerar det sanna operativa testet för modern artificiell intelligens. Det handlar inte om vad algoritmer kan uppnå under sterila laboratorieförhållanden, utan om vad de kan prestera i den krävande, nedkopplade verkligheten i det dagliga arbetet.

Edge-baserad AI för företag innebär att man kör optimerade neurala nätverk direkt på lokal hårdvara för att säkerställa oavbruten beräkningskraft, oavsett extern nätverksanslutning. Under mina sex år som AI-ingenjör, där jag byggt arkitekturer som fungerar i fält, har jag insett att nyttan är helt beroende av denna lokala motståndskraft. Teknikledare och operativt ansvariga — de främsta arkitekterna bakom dessa digitala ekosystem — inser snabbt att rå beräkningskraft spelar betydligt mindre roll än tillgänglighet. När vi bygger system för fältarbete skriver vi inte bara kod; vi konstruerar lokal autonomi.

Hårdvarufragmentering skapar det ultimata testet för driftsättning

En av de mest bestående realiteterna inom företagsteknologi är flottan av blandad hårdvara. Organisationer uppgraderar sällan alla enheter samtidigt. Ett företagsekosystem kan lätt innehålla enklare äldre enheter, arbetshästar i mellanklassen och premium-flaggskepp som alla används samtidigt. Att bygga programvara som förutsätter maximal hårdvarukapacitet är en säker väg mot operativt misslyckande.

Vid utveckling av AI-drivna mobila lösningar måste arkitekturen skalas elastiskt över hela detta hårdvaruspektrum. En äldre enhet, begränsad av sin neurala motor och termiska restriktioner, måste fortfarande kunna utföra centrala maskininlärningsuppgifter utan att tömma batteriet på tjugo minuter. Omvänt, när applikationen körs på nyare hårdvara, som en standard-iPhone 14 eller den större iPhone 14 Plus, bör den intuitivt kunna nyttja utökad minnesbandbredd och snabbare enhetlig minnesarkitektur för att hantera mer komplexa lokala slutledningar. Programvaran måste dynamiskt utvärdera hårdvaran den befinner sig på och justera sin beräkningsbelastning därefter.

Denna dynamiska skalning är avgörande eftersom slutanvändarens arbetsflöde förblir detsamma oavsett enhet. Teknikern förlitar sig på att verktygen fungerar tillförlitligt. Om ett verktyg för kontraktsanalys kräver molnbearbetning för att sammanfatta ett dokument och teknikern tappar uppkopplingen, upphör applikationen i praktiken att existera. Genom att skicka ut optimerade, uppgiftsspecifika modeller direkt till kanten (edge) säkerställer vi att grundläggande funktioner överlever nätverksstörningar.

Organisationer bygger lokala ekosystem för bearbetning

Branschen rör sig bort från antagandet att all artificiell intelligens måste bo i avlägsna, centraliserade serverhallar. De logistiska och ekonomiska omkostnaderna för att skicka varje bit företagsdata fram och tillbaka till en server börjar bli ohållbara, särskilt när datamängderna mångdubblas. Vi ser en grundläggande omstrukturering av hur företag närmar sig infrastruktur.

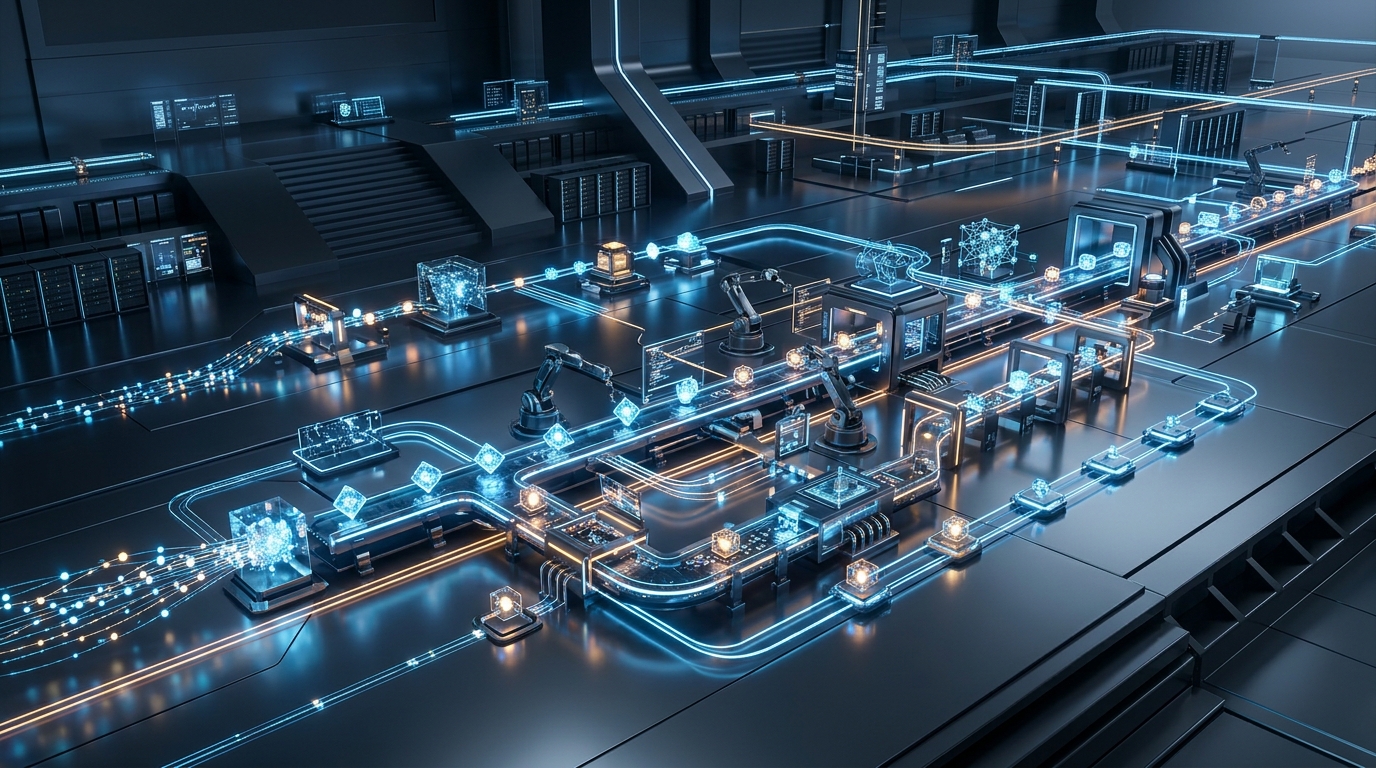

En färsk analys publicerad i MIT Sloan Management Review belyste just detta skifte. Krönikörerna Thomas H. Davenport och Randy Bean noterade att istället för att bygga massiva datacenter — en uppgift som vanligtvis överlämnas till leverantörer — skapar företag som använder dessa teknologier interna "AI-fabriker". Dessa fabriker är kombinationer av teknikplattformar, optimerade metoder, egenutvecklad data och tidigare utvecklade algoritmer som gör det mycket effektivt att bygga och distribuera intelligenta system i stor skala. Genom att standardisera processen kan organisationer snabbt skicka ut optimerade neurala modeller till användarnas enheter.

Denna lokala infrastruktur driver stora ekonomiska förändringar. Enligt färska marknadsrapporter växte marknaden för programvara för neurala nätverk från 31,2 miljarder dollar 2023 till beräknade 38,5 miljarder dollar 2024, till stor del drivet av företagens automatiseringsinsatser och spridningen av edge-kapabel programvara. Som ett företag som verkar djupt inom detta område observerar NeuralApps denna trend på nära håll. Företag nöjer sig inte längre med att hyra fjärrstyrd intelligens; de vill äga och distribuera lokal intelligens som lever direkt på deras enhetsflottor.

Uppgiftsspecifika agenter manövrerar ut generaliserade system

Att bygga en AI-fabrik kräver strikta beslut om vilka modeller som faktiskt är nödvändiga. Att pressa in en massiv, generaliserad språkmodell i en telefon är mycket ineffektivt. Generaliserade modeller bär på en enorm beräkningsvikt eftersom de är tränade att svara på frågor om allt från kvantfysik till antik historia. En fälttekniker behöver inte sin enhet för att skriva poesi; de behöver den för att exakt kategorisera en underhållsrapport.

Istället skiftar branschen mot högt specialiserade, autonoma agenter. Dessa är små, extremt optimerade neurala nätverk som är tränade att utföra en specifik uppgift exceptionellt bra. Enligt en prognos från Gartner kommer 40 % av alla företagsapplikationer att ha inbäddade uppgiftsspecifika AI-agenter vid slutet av 2025. Eftersom dessa modeller är beräkningsmässigt lätta kan de rymmas bekvämt inom minnesbegränsningarna för standardhårdvara och arbeta tyst i bakgrunden för att lösa användarproblem utan att tömma systemresurserna.

När man kombinerar dessa små modeller skapar man en komplex och lyhörd miljö. En agent kan hantera optisk teckenläsning (OCR) för dokumentskanning, medan en annan skickar den extraherade datan till rätt databasfält. Min kollega Umut Bayrak täckte detta ämne i detalj och utforskade de tekniska mekanismerna för att integrera effektiva neurala nätverk och lokala agenter i mobila hårdvaruarkitekturer. Målet är alltid att minska avståndet mellan användarens avsikt och den utförda handlingen.

En hållbar infrastruktur kräver strikt produktdisciplin

Övergången från en traditionell molnberoende arkitektur till en edge-fokuserad AI-fabrik kräver rigorös disciplin i utvecklingen. Varje funktion måste motivera sin beräkningskostnad. Det är lätt att bygga applikationer som ser imponerande ut i en demonstration i styrelserummet, men att utvärdera programvara kräver att man ser hur den presterar under ett hektiskt, högtryckspass en regnig tisdagseftermiddag.

Vid val eller utveckling av dessa plattformar bör teknikledare tillämpa ett strikt utvärderingsramverk. Först, fastställ offline-kapaciteten: exakt hur stor procentandel av applikationens kärnvärde fungerar utan internetanslutning? För det andra, utvärdera hårdvarans elasticitet: kan applikationen sänka sin bearbetningsintensitet på äldre enheter samtidigt som den maximerar den neurala kapaciteten på nyare? Slutligen, bedöm integrationen i arbetsflödet: sitter intelligensen naturligt i användarens befintliga väg, eller kräver den att de lämnar sin aktuella skärm för att interagera med ett separat gränssnitt?

Som ett mjukvaruutvecklingsföretag specialiserat på dessa arkitekturer är vår filosofi på NeuralApps rotad i denna praktiska verklighet. Vi tror att innovativa digitala upplevelser inte definieras av hur komplexa deras underliggande algoritmer är, utan av hur tyst de löser användarens problem. När vi bygger system som respekterar hårdvarubegränsningar, minimerar molnberoenden och prioriterar lokal exekvering, levererar vi programvara som faktiskt fungerar när det betyder som mest.