Considere uma engenheira de campo no subsolo de concreto de uma instalação industrial, totalmente isolada de redes celulares ou Wi-Fi. Ela precisa extrair cláusulas específicas de segurança elétrica de um manual esquemático denso de 500 páginas usando um editor de PDF móvel, executar uma rotina de diagnóstico complexa e registrar os dados preliminares de conformidade no sistema CRM da empresa. Ela está equipada com um iPhone 11 fornecido pela empresa. Três andares acima, o gerente do local monitora o fluxo de dados em um iPhone 14 Pro, aguardando a sincronização do sistema. Este ambiente representa o verdadeiro teste operacional para a inteligência artificial moderna. Não se trata do que os algoritmos podem alcançar em condições ideais de laboratório; trata-se do que eles conseguem executar nas realidades rudes e desconectadas do comércio diário.

A IA empresarial baseada em edge é a prática de executar redes neurais otimizadas diretamente no hardware local para garantir o processamento computacional ininterrupto, independentemente da conectividade externa. Em meus seis anos trabalhando como engenheiro de IA, construindo arquiteturas que funcionam em campo, percebi que a utilidade depende inteiramente dessa resiliência localizada. Líderes de tecnologia e diretores de operações — os principais arquitetos desses ecossistemas digitais — estão percebendo rapidamente que o poder bruto de processamento importa muito menos do que a acessibilidade. Quando construímos sistemas para o campo, não estamos apenas escrevendo código; estamos projetando autonomia localizada.

A fragmentação de hardware cria o teste definitivo de implementação

Uma das realidades mais persistentes na tecnologia empresarial é a frota de hardware híbrida. As organizações raramente atualizam todos os dispositivos simultaneamente. Um ecossistema corporativo pode facilmente conter dispositivos legados de entrada, modelos intermediários de alto desempenho e flagships premium operando simultaneamente. Desenvolver softwares que assumem a capacidade máxima de hardware é um caminho garantido para a falha operacional.

Ao desenvolver soluções móveis baseadas em IA, a arquitetura deve escalar de forma elástica por todo esse espectro de hardware. Um dispositivo mais antigo, limitado por seu motor neural e restrições térmicas, ainda precisa executar tarefas essenciais de machine learning sem esgotar a bateria em vinte minutos. Por outro lado, quando o aplicativo roda em hardware mais recente, como o iPhone 14 padrão ou o iPhone 14 Plus de tela maior, ele deve utilizar intuitivamente a maior largura de banda de memória e arquiteturas de memória unificada mais rápidas para processar inferências locais mais complexas. O software deve avaliar dinamicamente o hardware em que reside e ajustar sua carga computacional de acordo.

Essa escala dinâmica é crítica porque o fluxo de trabalho do usuário final permanece idêntico, independentemente do dispositivo. O técnico confia que suas ferramentas funcionarão com confiabilidade. Se uma ferramenta de análise de contratos exigir processamento em nuvem para resumir um documento e o técnico perder a conexão, o aplicativo efetivamente deixa de existir. Ao enviar modelos otimizados e específicos para tarefas diretamente para o edge, garantimos que as tarefas fundamentais sobrevivam à degradação da rede.

Organizações estão construindo ecossistemas de processamento localizados

A indústria está se afastando da premissa de que toda inteligência artificial deve residir em fazendas de servidores distantes e centralizadas. O custo logístico e financeiro de transmitir cada dado empresarial de ida e volta para um servidor está se tornando insustentável, especialmente à medida que o volume de dados se multiplica. Estamos vendo uma reestruturação fundamental na forma como as empresas abordam a infraestrutura.

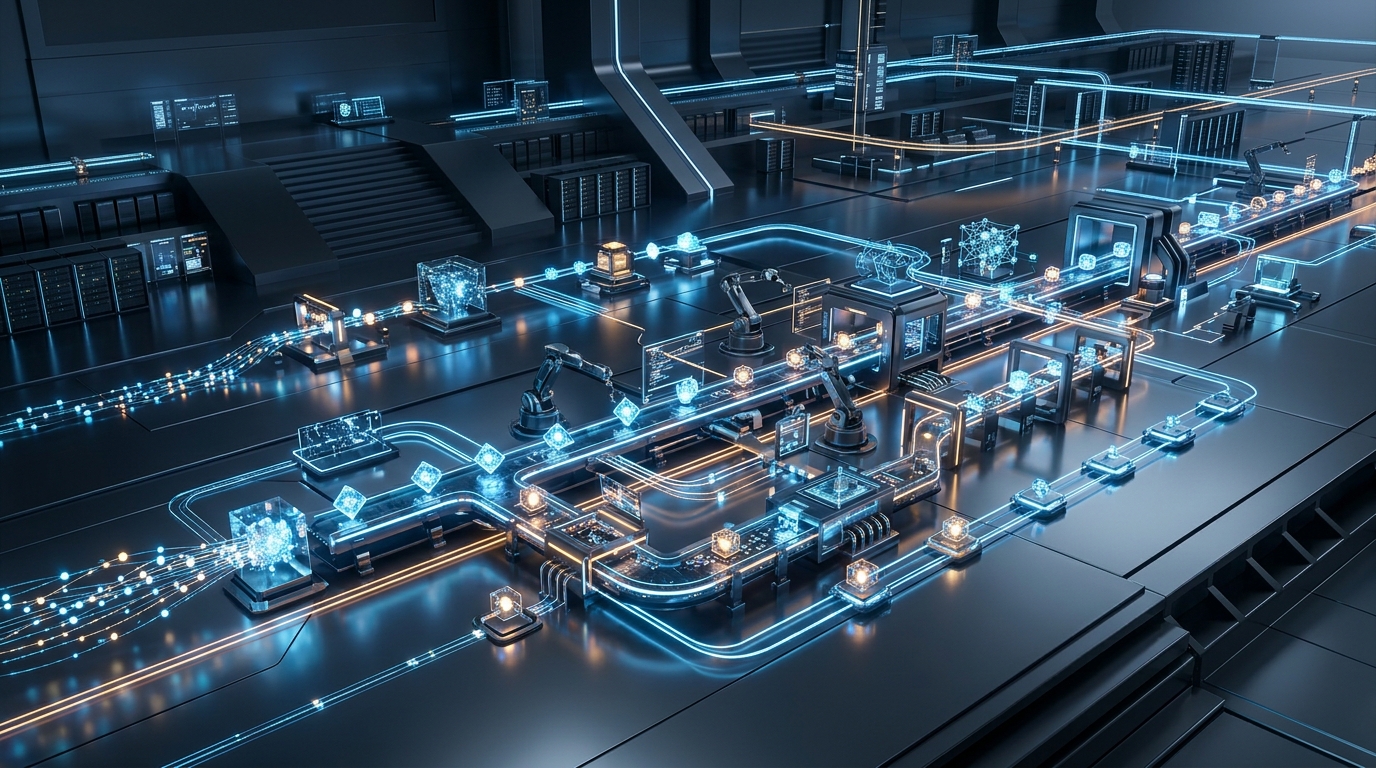

Uma análise recente publicada no MIT Sloan Management Review destacou exatamente essa mudança. Os colunistas Thomas H. Davenport e Randy Bean observaram que, em vez de construir centros de dados massivos — uma tarefa geralmente deixada para os fornecedores — as empresas que utilizam essas tecnologias estão criando "fábricas de IA" internas. Essas fábricas são combinações de plataformas tecnológicas, métodos otimizados, dados proprietários e algoritmos desenvolvidos anteriormente que tornam altamente eficiente a construção e implementação de sistemas inteligentes em escala. Ao padronizar o pipeline, as organizações podem enviar rapidamente modelos neurais otimizados para o edge.

Essa infraestrutura localizada está impulsionando mudanças econômicas massivas. De acordo com relatórios de mercado recentes, o mercado de software de redes neurais expandiu de US$ 31,2 bilhões em 2023 para uma projeção de US$ 38,5 bilhões em 2024, impulsionado em grande parte pelos esforços de automação empresarial e pela proliferação de softwares capazes de rodar em edge. Como uma empresa que opera profundamente neste espaço, a NeuralApps observa essa tendência em primeira mão. As empresas não estão mais satisfeitas em alugar inteligência remota; elas querem possuir e implementar inteligência localizada que reside diretamente nos dispositivos de sua frota.

Agentes focados em tarefas superam sistemas generalizados

Construir uma fábrica de IA requer decisões rigorosas sobre quais modelos são realmente necessários. Colocar um modelo de linguagem massivo e generalizado em um telefone é altamente ineficiente. Modelos generalizados carregam um peso computacional imenso porque são treinados para responder a perguntas sobre tudo, desde física quântica até história antiga. Um técnico de campo não precisa que seu dispositivo escreva poesia; ele precisa que categorize com precisão um registro de manutenção.

Em vez disso, a indústria está migrando para agentes autônomos altamente especializados. São redes neurais pequenas e ferozmente otimizadas, treinadas para executar uma tarefa específica excepcionalmente bem. Uma projeção recente do Gartner afirmou que, até o final de 2025, 40% das aplicações empresariais contarão com agentes de IA incorporados específicos para tarefas. Como esses modelos são leves computacionalmente, eles podem residir confortavelmente dentro das restrições de memória do hardware padrão, operando silenciosamente em segundo plano para resolver atritos do usuário sem drenar os recursos do sistema.

Quando você combina esses pequenos modelos, cria um ambiente complexo e responsivo. Um agente pode lidar com o reconhecimento óptico de caracteres para digitalização de documentos, enquanto outro roteia os dados extraídos para os campos apropriados do banco de dados. Meu colega Umut Bayrak abordou este tópico em detalhes, explorando a mecânica técnica de integração de redes neurais eficientes e agentes localizados em arquiteturas de hardware móvel. O objetivo é sempre reduzir a distância entre a intenção do usuário e a ação concluída.

Uma infraestrutura sustentável exige uma disciplina rigorosa de produto

A transição de uma arquitetura tradicional dependente da nuvem para uma fábrica de IA focada em edge exige uma disciplina rigorosa no desenvolvimento. Cada funcionalidade deve justificar seu custo computacional. É fácil construir aplicações que parecem impressionantes em uma demonstração de diretoria, mas a avaliação real do software exige observar como ele performa durante um turno frenético e sob pressão em uma tarde chuvosa de terça-feira.

Ao selecionar ou desenvolver essas plataformas, os líderes de tecnologia devem aplicar uma estrutura de avaliação estrita. Primeiro, determine a capacidade offline: qual porcentagem exata da proposta de valor central do aplicativo funciona sem conexão à internet? Segundo, avalie a elasticidade do hardware: o aplicativo degrada graciosamente sua intensidade de processamento em dispositivos mais antigos enquanto maximiza a capacidade neural dos mais novos? Finalmente, avalie a integração do fluxo de trabalho: a inteligência está naturalmente inserida no caminho existente do usuário ou exige que ele abandone sua tela atual para interagir com uma interface de conversa separada?

Como uma empresa de desenvolvimento de software especializada nessas arquiteturas, nossa filosofia na NeuralApps está enraizada nesta realidade prática. Acreditamos que experiências digitais inovadoras não são definidas pela complexidade de seus algoritmos subjacentes, mas pela quietude com que resolvem o problema do usuário. Quando construímos sistemas que respeitam os limites do hardware, minimizam a dependência da nuvem e priorizam a execução localizada, entregamos software que realmente funciona quando mais importa.