Forestil dig en felttekniker, der står i den betonstøbte kælder under en kommerciel produktionsfacilitet, helt afskåret fra mobil- og trådløse netværk. Hun skal udtrække specifikke elsikkerhedsklausuler fra en tæt, 500-siders teknisk manual ved hjælp af en mobil PDF-editor, udføre en kompleks diagnostisk rutine og logge de foreløbige overensstemmelsesdata i virksomhedens CRM-system. Hun er udstyret med en firmaudleveret iPhone 11. Tre etager over hende overvåger driftslederen de indgående datastrømme på en iPhone 14 Pro, mens han venter på, at systemet synkroniserer. Dette miljø repræsenterer den sande operationelle test for moderne kunstig intelligens. Det handler ikke om, hvad algoritmer kan opnå under sterile laboratorieforhold; det handler om, hvad de kan udføre i hverdagens rå og afskoblede virkelighed.

Edge-aktiveret enterprise AI handler om at køre optimerede neurale netværk direkte på lokal hardware for at sikre uafbrudt beregningskraft, uanset ekstern netværksforbindelse. I mine seks år som AI-ingeniør, hvor jeg har bygget arkitekturer til brug i felten, er det gået op for mig, at nytten er fuldstændig afhængig af denne lokale modstandsdygtighed. Teknologiledere og driftsdirektører — de primære arkitekter bag disse digitale økosystemer — indser hurtigt, at rå processorkraft betyder langt mindre end tilgængelighed. Når vi bygger systemer til felten, skriver vi ikke bare kode; vi konstruerer lokal autonomi.

Hardware-fragmentering skaber den ultimative udrulningstest

En af de mest vedholdende realiteter i virksomhedsteknologi er den blandede hardware-flåde. Organisationer opgraderer sjældent alle enheder samtidigt. Et virksomhedsøkosystem kan nemt indeholde ældre basismodeller, solide mellemklasse-enheder og premium-flagskibe, der alle opererer på samme tid. At bygge software, der forudsætter maksimal hardwarekapacitet, er en sikker vej til operationel fiasko.

Når man udvikler AI-drevne mobile løsninger, skal arkitekturen kunne skalere elastisk på tværs af dette hardware-spektrum. En ældre enhed, der er begrænset af sin neural engine og termiske begrænsninger, skal stadig kunne udføre kerneopgaver inden for maskinlæring uden at dræne batteriet på tyve minutter. Omvendt, når applikationen kører på nyere hardware, såsom standard iPhone 14 eller den større iPhone 14 Plus, bør den intuitivt udnytte den udvidede hukommelsesbåndbredde og hurtigere arkitektur for at behandle mere komplekse lokale slutninger. Softwaren skal dynamisk vurdere den hardware, den lever på, og justere sin beregningsmæssige belastning derefter.

Denne dynamiske skalering er kritisk, fordi slutbrugerens workflow forbliver det samme uanset enheden. Teknikeren er afhængig af, at deres værktøjer fungerer pålideligt. Hvis et værktøj til kontraktanalyse kræver cloud-behandling for at opsummere et dokument, og teknikeren mister forbindelsen, ophører applikationen reelt med at eksistere. Ved at skubbe optimerede, opgavespecifikke modeller direkte ud til kanten (edge), sikrer vi, at de fundamentale opgaver overlever netværksnedbrud.

Organisationer opbygger lokale økosystemer til databehandling

Branchen bevæger sig væk fra antagelsen om, at al kunstig intelligens skal bo i fjerne, centraliserede serverparker. Den logistiske og økonomiske omkostning ved at sende hver eneste bid virksomhedsdata frem og tilbage til en server er ved at blive uholdbar, især i takt med at datamængderne mangedobles. Vi ser en fundamental omstrukturering af, hvordan virksomheder griber infrastruktur an.

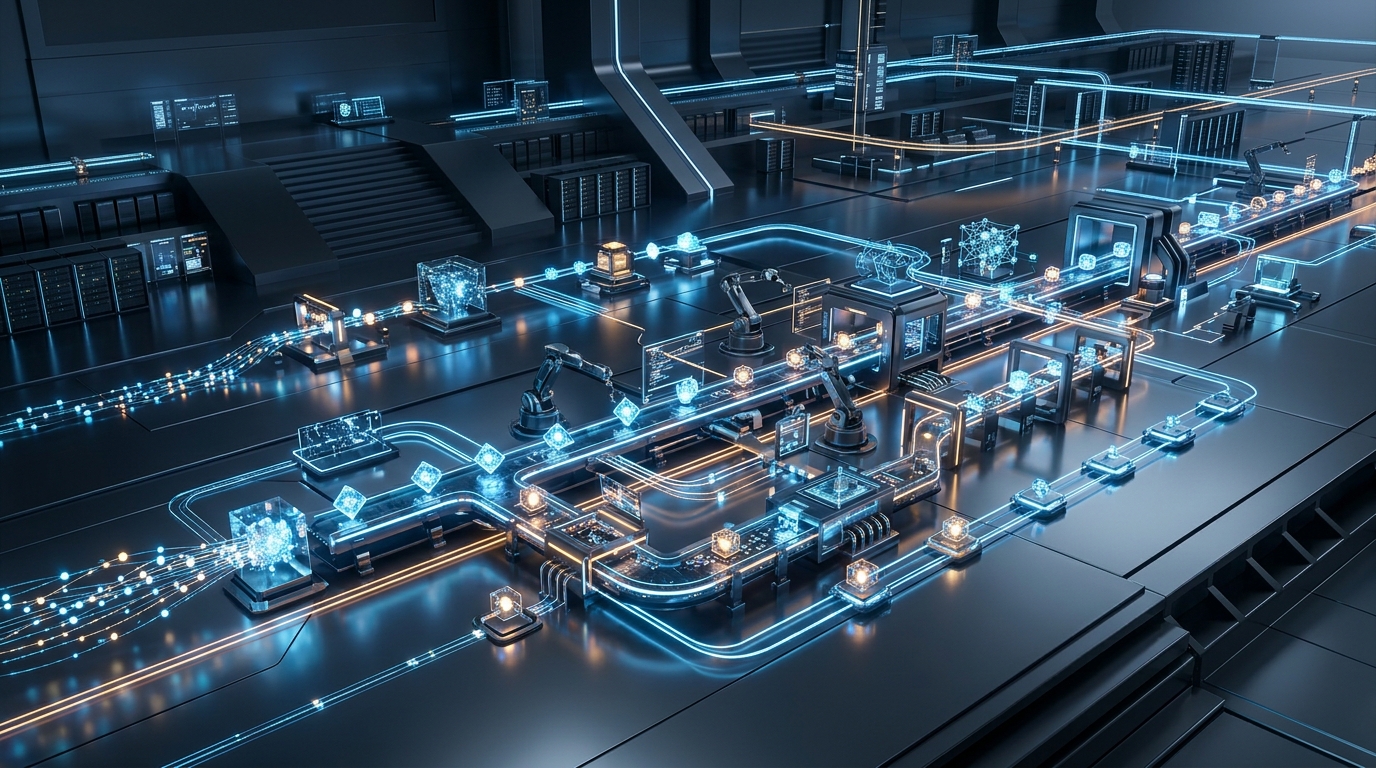

En nylig analyse offentliggjort i MIT Sloan Management Review fremhævede netop dette skift. Klummeskribenterne Thomas H. Davenport og Randy Bean bemærkede, at i stedet for at bygge massive datacentre — en opgave der normalt overlades til leverandører — skaber virksomheder, der udnytter disse teknologier, interne "AI-fabrikker". Disse fabrikker er en kombination af teknologiplatforme, optimerede metoder, proprietære data og tidligere udviklede algoritmer, der gør det yderst effektivt at bygge og udrulle intelligente systemer i stor skala. Ved at standardisere pipelinen kan organisationer hurtigt skubbe optimerede neurale modeller ud til kanten.

Denne lokale infrastruktur driver massive økonomiske skift. Ifølge nyere markedsrapporter voksede markedet for software til neurale netværk fra 31,2 milliarder dollars i 2023 til forventede 38,5 milliarder dollars i 2024, i høj grad drevet af virksomhedernes automatiseringsindsats og udbredelsen af edge-kapabel software. Som en virksomhed, der opererer dybt i dette felt, observerer NeuralApps denne tendens på tætteste hold. Virksomheder er ikke længere tilfredse med at leje fjern intelligens; de vil eje og udrulle lokal intelligens, der lever direkte på deres flåde af enheder.

Opgavespecifikke agenter udmanøvrerer generaliserede systemer

At bygge en AI-fabrik kræver, at man træffer strenge beslutninger om, hvilke modeller der rent faktisk er nødvendige. At presse en massiv, generaliseret sprogmodel ind på en telefon er yderst ineffektivt. Generaliserede modeller bærer en enorm beregningsmæssig vægt, fordi de er trænet til at besvare spørgsmål om alt fra kvantefysik til oldtidens historie. En felttekniker har ikke brug for, at deres enhed skriver poesi; de har brug for, at den præcist kategoriserer en vedligeholdelsesrapport.

I stedet skifter branchen mod højt specialiserede, autonome agenter. Dette er små, stærkt optimerede neurale netværk, der er trænet til at udføre én meget specifik opgave exceptionelt godt. En nylig fremskrivning fra Gartner konstaterede, at ved udgangen af 2025 vil 40 % af enterprise-applikationer have indbyggede opgavespecifikke AI-agenter. Da disse modeller er beregningsmæssigt lette, kan de ligge komfortabelt inden for hukommelsesbegrænsningerne i standardhardware og køre stille i baggrunden for at løse brugerens udfordringer uden at dræne systemressourcerne.

Når man kombinerer disse små modeller, skaber man et komplekst, responsivt miljø. Én agent kan håndtere optisk tegngenkendelse (OCR) til dokumentskanning, mens en anden router de udtrukne data til de korrekte databasefelter. Min kollega Umut Bayrak dækkede dette emne i detaljer og udforskede de tekniske mekanismer bag integration af effektive neurale netværk og lokale agenter i mobile hardware-arkitekturer. Målet er altid at mindske afstanden mellem brugerens hensigt og den udførte handling.

En bæredygtig infrastruktur kræver streng produktdisciplin

Overgangen fra en traditionel cloud-afhængig arkitektur til en edge-først AI-fabrik kræver streng disciplin i udviklingen. Hver funktion skal retfærdiggøre sin beregningsmæssige omkostning. Det er nemt at bygge applikationer, der ser imponerende ud i en præsentation i bestyrelseslokalet, men vurdering af software kræver, at man ser på, hvordan den præsterer under et hektisk, højtryks-skift på en regnfuld tirsdag eftermiddag.

Når man vælger eller udvikler disse platforme, bør teknologiledere anvende en streng evalueringsramme. Først skal offline-kapaciteten fastlægges: Præcis hvor stor en procentdel af applikationens kerneværdi fungerer uden internetforbindelse? For det andet skal hardware-elasticiteten vurderes: Kan applikationen drosle sin procesintensitet ned på ældre enheder, mens den maksimerer den neurale kapacitet på nyere? Til sidst skal workflow-integrationen vurderes: Sidder intelligensen naturligt i brugerens eksisterende arbejdsproces, eller kræver det, at de forlader deres nuværende skærm for at interagere med en separat chatgrænseflade?

Som et softwareudviklingshus, der specialiserer sig i disse arkitekturer, er vores filosofi hos NeuralApps rodfæstet i denne praktiske virkelighed. Vi mener, at innovative digitale oplevelser ikke defineres af, hvor komplekse de underliggende algoritmer er, men af hvor lydløst de løser brugerens problem. Når vi bygger systemer, der respekterer hardwaregrænser, minimerer cloud-afhængigheder og prioriterer lokal eksekvering, leverer vi software, der rent faktisk virker, når det gælder mest.