Stel je een onderhoudstechnicus voor in de betonnen kelder van een commerciële productiefaciliteit, volledig afgesneden van mobiele en draadloze netwerken. Ze moet specifieke elektrische veiligheidsclausules uit een lijvige technische handleiding van 500 pagina's halen met een mobiele pdf-editor, een complexe diagnostische routine uitvoeren en de voorlopige compliance-gegevens loggen in het CRM-systeem van de onderneming. Ze is uitgerust met een iPhone 11 van de zaak. Drie verdiepingen boven haar houdt de locatiemanager inkomende datastromen in de gaten op een iPhone 14 Pro, wachtend tot het systeem synchroniseert. Deze omgeving vormt de echte operationele test voor moderne kunstmatige intelligentie. Het gaat er niet om wat algoritmen kunnen bereiken in steriele laboratoriumomstandigheden; het gaat erom wat ze kunnen presteren in de weerbarstige, offline realiteit van het dagelijkse bedrijfsleven.

Edge-gebaseerde enterprise AI is het draaien van geoptimaliseerde neurale netwerken direct op lokale hardware om ononderbroken verwerking te garanderen, ongeacht de externe netwerkverbinding. In de zes jaar dat ik als AI-engineer werk aan architecturen voor gebruik in het veld, ben ik gaan inzien dat bruikbaarheid volledig afhankelijk is van deze lokale veerkracht. Technologische leiders en operationeel directeuren — de architecten van deze digitale ecosystemen — realiseren zich snel dat ruwe rekenkracht veel minder belangrijk is dan toegankelijkheid. Wanneer we systemen bouwen voor de praktijk, schrijven we niet alleen code; we ontwerpen lokale autonomie.

Hardware-fragmentatie als de ultieme implementatietest

Een van de meest hardnekkige realiteiten in enterprise technologie is het gemengde hardwarepark. Organisaties upgraden zelden alle apparaten tegelijkertijd. Een zakelijk ecosysteem kan gemakkelijk bestaan uit verouderde instapmodellen, mid-range werkpaarden en premium vlaggenschepen die allemaal tegelijkertijd worden gebruikt. Software ontwikkelen die uitgaat van maximale hardwarecapaciteit is een gegarandeerde weg naar operationele mislukking.

Bij het ontwikkelen van AI-gestuurde mobiele oplossingen moet de architectuur elastisch schalen over dit hardwarespectrum. Een ouder apparaat, beperkt door zijn neural engine en thermische limieten, moet nog steeds kernfuncties van machine learning uitvoeren zonder de batterij in twintig minuten leeg te trekken. Omgekeerd moet de applicatie, wanneer deze draait op nieuwere hardware zoals de iPhone 14 of de iPhone 14 Plus, intuïtief gebruikmaken van de grotere geheugenbandbreedte en snellere unified memory-architecturen om complexere lokale berekeningen uit te voeren. De software moet dynamisch beoordelen op welke hardware hij draait en de rekenlast dienovereenkomstig aanpassen.

Deze dynamische schaling is cruciaal omdat de workflow van de eindgebruiker identiek blijft, ongeacht het apparaat. De technicus rekent op gereedschap dat betrouwbaar functioneert. Als een tool voor contractanalyse cloudverwerking nodig heeft om een document samen te vatten en de technicus verliest de verbinding, dan houdt de applicatie feitelijk op te bestaan. Door geoptimaliseerde, taakspecifieke modellen direct naar de 'edge' te pushen, zorgen we ervoor dat fundamentele taken ook bij netwerkstoringen blijven functioneren.

Organisaties bouwen aan lokale verwerkingsecosystemen

De sector stapt af van de aanname dat alle kunstmatige intelligentie in verre, gecentraliseerde serverparken moet leven. De logistieke en financiële overhead van het heen en weer sturen van elke byte aan bedrijfsgegevens naar een server wordt onhoudbaar, vooral nu het datavolume exponentieel toeneemt. We zien een fundamentele herstructurering in de manier waarop bedrijven infrastructuur benaderen.

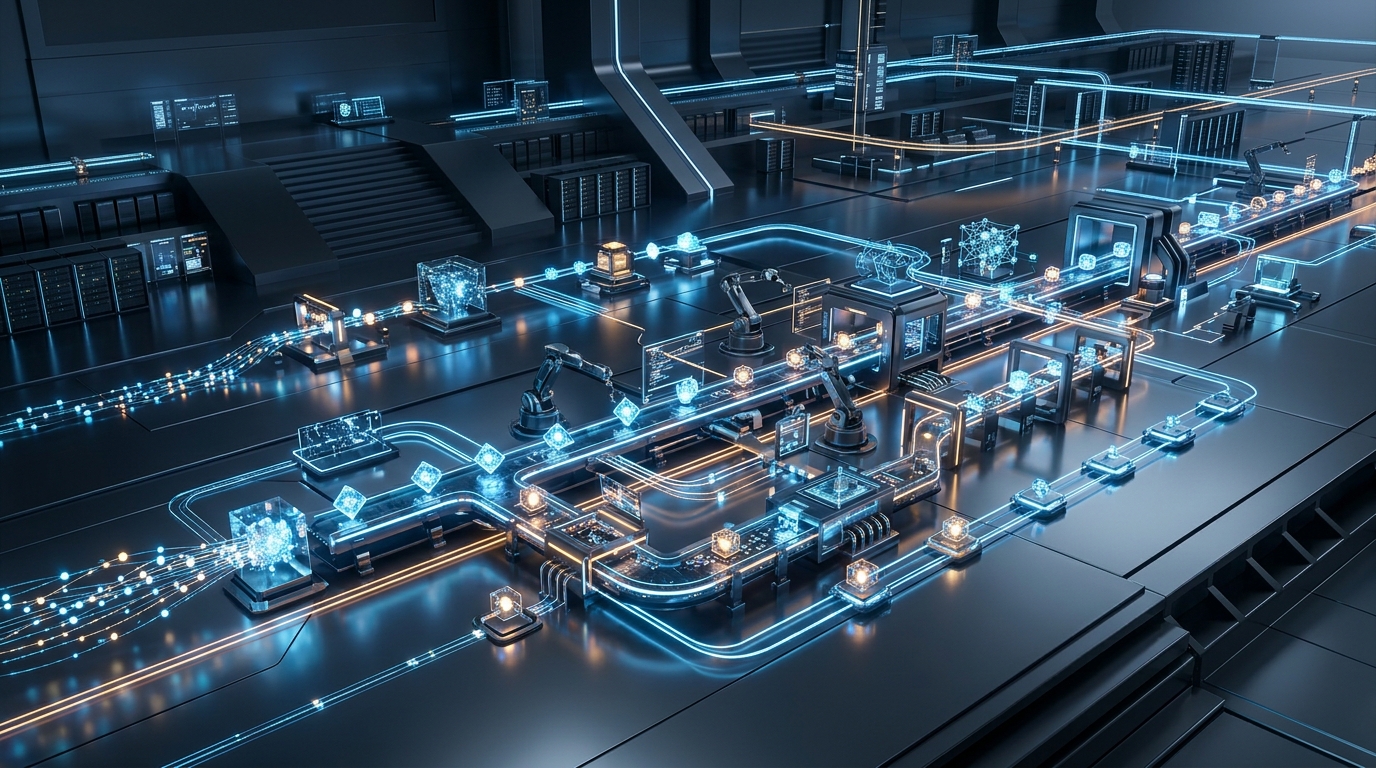

Een recente analyse in de MIT Sloan Management Review benadrukte precies deze verschuiving. Columnisten Thomas H. Davenport en Randy Bean merkten op dat bedrijven die deze technologieën gebruiken, in plaats van massale datacenters te bouwen — een taak die meestal aan leveranciers wordt overgelaten — interne 'AI-fabrieken' creëren. Deze fabrieken zijn combinaties van technologieplatforms, geoptimaliseerde methoden, eigen data en eerder ontwikkelde algoritmen die het zeer efficiënt maken om intelligente systemen op schaal te bouwen en te implementeren. Door de pipeline te standaardiseren, kunnen organisaties geoptimaliseerde neurale modellen razendsnel naar de rand van het netwerk pushen.

Deze lokale infrastructuur zorgt voor enorme economische verschuivingen. Volgens recente marktrapporten groeide de markt voor neurale netwerksoftware van $31,2 miljard in 2023 naar een verwachte $38,5 miljard in 2024, grotendeels gedreven door automatisering in de enterprise-sector en de opkomst van edge-ready software. Als bedrijf dat diep in deze sector opereert, ziet NeuralApps deze trend uit de eerste hand. Ondernemingen nemen geen genoegen meer met het huren van intelligentie op afstand; ze willen lokale intelligentie bezitten en inzetten die direct op de apparaten van hun medewerkers leeft.

Taakspecifieke agents overtreffen algemene systemen

Het bouwen van een AI-fabriek vereist strikte keuzes over welke modellen daadwerkelijk nodig zijn. Een gigantisch, algemeen taalmodel op een telefoon pushen is uiterst inefficiënt. Algemene modellen dragen een enorme rekenlast omdat ze getraind zijn om vragen te beantwoorden over alles, van kwantumfysica tot de klassieke oudheid. Een onderhoudstechnicus heeft geen apparaat nodig dat gedichten schrijft; hij heeft een apparaat nodig dat een onderhoudsrapport nauwkeurig categoriseert.

In plaats daarvan verschuift de industrie naar zeer gespecialiseerde, autonome agents. Dit zijn kleine, uiterst geoptimaliseerde neurale netwerken die getraind zijn om één specifieke taak uitzonderlijk goed uit te voeren. Een recente prognose van Gartner stelt dat tegen eind 2025 40% van de enterprise-applicaties ingebedde taakspecifieke AI-agents zal bevatten. Omdat deze modellen lichtgewicht zijn, passen ze comfortabel binnen de geheugenbeperkingen van standaard hardware, waarbij ze stilletjes op de achtergrond werken zonder de systeembronnen uit te putten.

Wanneer je deze kleine modellen combineert, ontstaat er een complex, responsief ecosysteem. De ene agent kan de optische tekenherkenning (OCR) voor het scannen van documenten afhandelen, terwijl een andere de geëxtraheerde gegevens naar de juiste databasevelden stuurt. Mijn collega Umut Bayrak ging uitgebreid op dit onderwerp in en verkende de technische mechanismen van het integreren van efficiënte neurale netwerken en lokale agents in mobiele architecturen. Het doel is altijd om de afstand tussen de intentie van de gebruiker en de voltooide actie te verkleinen.

Duurzame infrastructuur vereist strikte productdiscipline

De overstap van een traditionele, cloud-afhankelijke architectuur naar een edge-first AI-fabriek vereist strikte discipline in ontwikkeling. Elke feature moet zijn rekenkracht-kosten rechtvaardigen. Het is eenvoudig om applicaties te bouwen die indruk maken in een directiekamer, maar de echte waarde van software wordt pas duidelijk tijdens een hectische shift op een regenachtige dinsdagmiddag.

Bij het selecteren of ontwikkelen van deze platforms moeten technologische leiders een strikt evaluatiekader hanteren. Ten eerste: bepaal de offline functionaliteit. Welk percentage van de kernwaarde van de applicatie werkt zonder internetverbinding? Ten tweede: beoordeel de hardware-elasticiteit. Schaalt de applicatie de verwerkingsintensiteit op oudere apparaten op een elegante manier terug, terwijl de neurale capaciteit van nieuwere devices maximaal wordt benut? Ten slotte: beoordeel de workflow-integratie. Zit de intelligentie op een natuurlijke manier in het pad van de gebruiker, of moet deze zijn huidige scherm verlaten om met een aparte interface te communiceren?

Als softwareontwikkelingsbureau gespecialiseerd in deze architecturen, is onze filosofie bij NeuralApps geworteld in deze praktische realiteit. Wij geloven dat innovatieve digitale ervaringen niet worden bepaald door hoe complex de onderliggende algoritmen zijn, maar door hoe onopvallend ze het probleem van de gebruiker oplossen. Wanneer we systemen bouwen die hardwarelimieten respecteren, cloud-afhankelijkheid minimaliseren en prioriteit geven aan lokale uitvoering, leveren we software die daadwerkelijk werkt wanneer het er het meest toe doet.